第1章“Introduction”详细讲解

本章是《Probabilistic Machine Learning: An Introduction》的开篇,旨在为读者建立机器学习的基本框架,定义核心概念,介绍三种主要的学习范式(监督学习、无监督学习、强化学习),并讨论数据预处理和常见数据集。本章内容为全书后续章节奠定基础,强调概率视角在机器学习中的核心地位。

1.1 什么是机器学习?

定义:一个计算机程序从经验 $E$ 中学习,针对某类任务 $T$ 和性能度量 $P$,如果它在任务 $T$ 上的性能(以 $P$ 衡量)随着经验 $E$ 而提高。(Tom Mitchell)

解释:

- 任务 $T$:系统要完成的目标(例如分类、回归)。

- 经验 $E$:训练数据或交互历史。

- 性能 $P$:衡量任务完成质量的指标(如准确率、均方误差)。

概率视角:本书将所有未知量(如未来预测、模型参数)视为随机变量,用概率分布描述其不确定性。这种视角的优势在于:

- 它是处理不确定性的最优决策框架(第5章)。

- 它是连接机器学习与统计学、信息论、控制论等其他科学领域的统一语言。

1.2 监督学习

监督学习是最常见的机器学习形式。其核心是学习一个从输入 $x \in \mathcal{X}$ 到输出 $y \in \mathcal{Y}$ 的映射 $f$,基于已知的输入-输出对训练集 $\mathcal{D} = \{(x_n, y_n)\}_{n=1}^N$。

1.2.1 分类

- 定义:输出空间是离散的、互斥的类别集合 $\mathcal{Y} = \{1,2,\ldots,C\}$。

- 二分类:$C=2$,通常记 $y \in \{0,1\}$ 或 $y \in \{-1,+1\}$。

- 多分类:$C>2$。

1.2.1.1 示例:鸢尾花分类

- 数据集:Iris数据集,150个样本,4个数值特征(萼片长度、萼片宽度、花瓣长度、花瓣宽度),3个类别(Setosa, Versicolor, Virginica)。

- 设计矩阵:$N \times D$ 矩阵,每行一个样本,每列一个特征。表1.1展示了部分数据。

1.2.1.2 探索性数据分析

- 目的:在建模前了解数据分布、发现模式、检测异常。

- 常用方法:

- 散点图矩阵(pair plot):显示特征两两之间的关系,对角线显示边缘密度,颜色编码类别(图1.3)。

- 降维可视化:对高维数据先用PCA等降维,再在2D/3D中展示。

1.2.1.3 学习一个分类器

以决策树为例(图1.4):

- 决策规则:例如,若花瓣长度 < 2.45 → Setosa,否则为Versicolor或Virginica。

- 递归划分:对误分类区域继续划分,形成树结构。

- 参数:每个内部节点包含特征索引和阈值,记为 $\theta$。

1.2.1.4 经验风险最小化

- 损失函数 $\ell(y, \hat{y})$:度量预测 $\hat{y}$ 与真实标签 $y$ 的差异。

- 0-1损失:$\ell_{01}(y,\hat{y}) = \mathbb{I}(y \neq \hat{y})$。

- 非对称损失:不同错误类型代价不同(如表1.2,将Virginica误分类为Setosa代价高)。

- 经验风险:训练集上的平均损失: $$ \mathcal{L}(\theta) = \frac{1}{N}\sum_{n=1}^N \ell(y_n, f(x_n;\theta)) $$

- 经验风险最小化(ERM):寻找使经验风险最小的参数 $\hat{\theta} = \arg\min \mathcal{L}(\theta)$。

1.2.1.5 不确定性

- 原因:

- 认知不确定性(epistemic uncertainty):由于模型知识不足(如参数不确定)。

- 随机不确定性(aleatoric uncertainty):数据内在的随机性(如噪声)。

- 概率建模:用条件概率分布 $p(y=c|x;\theta)$ 表示不确定性,满足 $0 \le p_c \le 1$ 且 $\sum_c p_c = 1$。

- Softmax函数:将实数向量(logits)映射为概率分布: $$ \mathrm{softmax}(\mathbf{a})_c = \frac{e^{a_c}}{\sum_{c'} e^{a_{c'}}} $$ 其中 $\mathbf{a} = f(x;\theta)$ 为logits。

- 逻辑回归:当 $f$ 为线性函数时,$p(y=c|x) = \mathrm{softmax}_c(\mathbf{w}^\top x + b)$。

1.2.1.6 最大似然估计

- 负对数似然(NLL): $$ \mathrm{NLL}(\theta) = -\frac{1}{N}\sum_{n=1}^N \log p(y_n|x_n;\theta) $$

- 最大似然估计(MLE):最小化NLL得到 $\hat{\theta}_{\text{mle}}$。

1.2.2 回归

- 定义:输出是连续值 $y \in \mathbb{R}$。

- 常见损失:平方损失 $\ell_2(y,\hat{y}) = (y-\hat{y})^2$。

- 均方误差(MSE):$\mathrm{MSE}(\theta) = \frac{1}{N}\sum_{n=1}^N (y_n - f(x_n;\theta))^2$。

- 概率视角:假设 $y$ 服从高斯分布 $p(y|x;\theta) = \mathcal{N}(y|f(x;\theta),\sigma^2)$,则最小化MSE等价于MLE。

1.2.2.1 线性回归

- 模型:$f(x;\theta) = \mathbf{w}^\top x + b$。

- 最小二乘解:$\hat{\theta} = \arg\min \mathrm{MSE}(\theta)$。

1.2.2.2 多项式回归

- 特征扩展:将输入 $x$ 映射到多项式特征 $\phi(x) = [1, x, x^2, \ldots, x^D]$。

- 模型:$f(x;\mathbf{w}) = \mathbf{w}^\top \phi(x)$。仍为线性参数模型,但输入非线性。

1.2.2.3 深度神经网络

- 思想:学习特征提取器,形成多层嵌套函数: $$ f(x;\theta) = f_L(f_{L-1}(\cdots f_1(x)\cdots)) $$

- 意义:自动学习有用特征,无需手工设计。

1.2.3 过拟合与泛化

- 过拟合:模型在训练集上表现很好,但在新数据上表现差(图1.7c)。

- 泛化能力:模型对未见数据的预测能力。

- 训练/测试划分:将数据分为训练集、验证集、测试集。用测试误差近似泛化误差。

- 泛化差距:测试误差与训练误差之差。

1.2.4 没有免费午餐定理

- 陈述:不存在一个模型对所有问题都最优。任何模型都有其归纳偏置(假设),适用于某些领域,不适用于其他领域。

- 启示:需根据领域知识和实验选择模型。

1.3 无监督学习

- 定义:从无标签数据 $\mathcal{D} = \{x_n\}$ 中学习,目标是发现数据内在结构。

- 概率视角:学习无条件模型 $p(x)$。

1.3.1 聚类

- 目标:将数据划分成“相似”的组(簇)。

- 示例:Iris数据(图1.8),用K-means聚类成3簇。注意簇数需权衡(模型复杂度与拟合度)。

1.3.2 发现潜在“变化因素”

- 降维:假设高维观测数据由低维潜在变量 $z$ 生成。

- 线性因子模型:例如因子分析(FA)和概率主成分分析(PPCA)。

- $p(x|z;\theta) = \mathcal{N}(x|\mathbf{W}z + \mu, \mathbf{\Sigma})$,$z \sim \mathcal{N}(0,\mathbf{I})$。

- 非线性扩展:深度神经网络作为映射,如变分自编码器(VAE)。

1.3.3 自监督学习

- 思想:从无标签数据构造代理监督任务(如预测图像的颜色、预测被遮盖的词),学习有用特征,再用于下游任务。

1.3.4 评估无监督学习

- 密度估计:用测试集上的负对数似然 $\mathcal{L}(\theta) = -\frac{1}{|\mathcal{D}|}\sum_{x\in\mathcal{D}}\log p(x|\theta)$ 衡量模型质量。

- 下游任务性能:用学到的表示作为特征,在少量标注数据上训练分类器,评估其性能。

1.4 强化学习

- 定义:智能体(agent)通过与环境交互学习最优策略 $\pi(x)$,以最大化累积奖励。

- 特点:

- 无直接监督信号,只有延迟的奖励。

- 需平衡探索(exploration)与利用(exploitation)。

- 与监督学习的关系:Yann LeCun的“蛋糕比喻”:无监督学习是蛋糕体,监督学习是 icing,强化学习是樱桃(图1.11)。

1.5 数据

1.5.1 常见图像数据集

| 数据集 | 描述 | 规模 | 用途 |

|---|---|---|---|

| MNIST | 手写数字,28×28灰度 | 60k训练,10k测试 | 入门级分类 |

| EMNIST | 扩展MNIST,含字母 | 697k训练 | 更难分类 |

| Fashion-MNIST | 服装图片 | 同上 | 替代MNIST |

| CIFAR-10/100 | 32×32彩色,10/100类 | 50k训练,10k测试 | 常见基准 |

| ImageNet | 256×256彩色,1000类 | 1.3M训练 | 大规模挑战 |

1.5.2 常见文本数据集

- IMDB电影评论:二分类情感分析,25k训练+25k测试。

- 机器翻译:如WMT英-德平行语料。

- SQuAD:问答数据集,从文本中提取答案。

- 语言建模:无监督学习文本序列分布。

1.5.3 预处理离散输入数据

1.5.3.1 One-hot编码

- 定义:将 $K$ 个取值的分类变量转换为 $K$ 维二进制向量,仅对应位置为1。

- 示例:颜色 {红,绿,蓝} → 红=(1,0,0), 绿=(0,1,0), 蓝=(0,0,1)。

1.5.3.2 特征交叉

- 目的:捕捉特征间的交互作用。

- 方法:创建新特征表示组合(如SUV且美国产)。线性模型用此可建模非线性关系。

1.5.4 预处理文本数据

1.5.4.1 Bag-of-words模型

- 步骤:分词、去停用词、词干提取,统计词频得到文档向量。

1.5.4.2 TF-IDF

- 公式:$\text{TF-IDF}_{ij} = \log(\text{TF}_{ij}+1) \times \log\frac{N}{1+\text{DF}_i}$。

- 作用:降低常见词权重,突出重要词。

1.5.4.3 词嵌入

- 思想:将 one-hot 词映射为低维稠密向量,使语义相似的词向量相近。

- 示例:$\mathbf{e}_{nt} = \mathbf{E}\mathbf{x}_{nt}$,其中 $\mathbf{E}$ 为嵌入矩阵。

1.5.4.4 处理新词

- OOV问题:用

<UNK>替换未见词,或用子词单元(如byte-pair encoding)。

1.5.5 处理缺失数据

- 缺失机制:

- MCAR(完全随机缺失):缺失与数据无关。

- MAR(随机缺失):缺失依赖于观测数据。

- NMAR(非随机缺失):缺失依赖于未观测值。

- 处理:均值填充、生成模型插补等。

1.6 讨论

1.6.1 ML与其他领域的关系

- 数据挖掘:侧重于结构化数据。

- 数据科学:结合ML、统计、可视化、领域知识。

- 统计学:与ML紧密相连,ML可视为计算统计学。

- 人工智能:ML是实现AI的关键技术。

1.6.2 本书结构

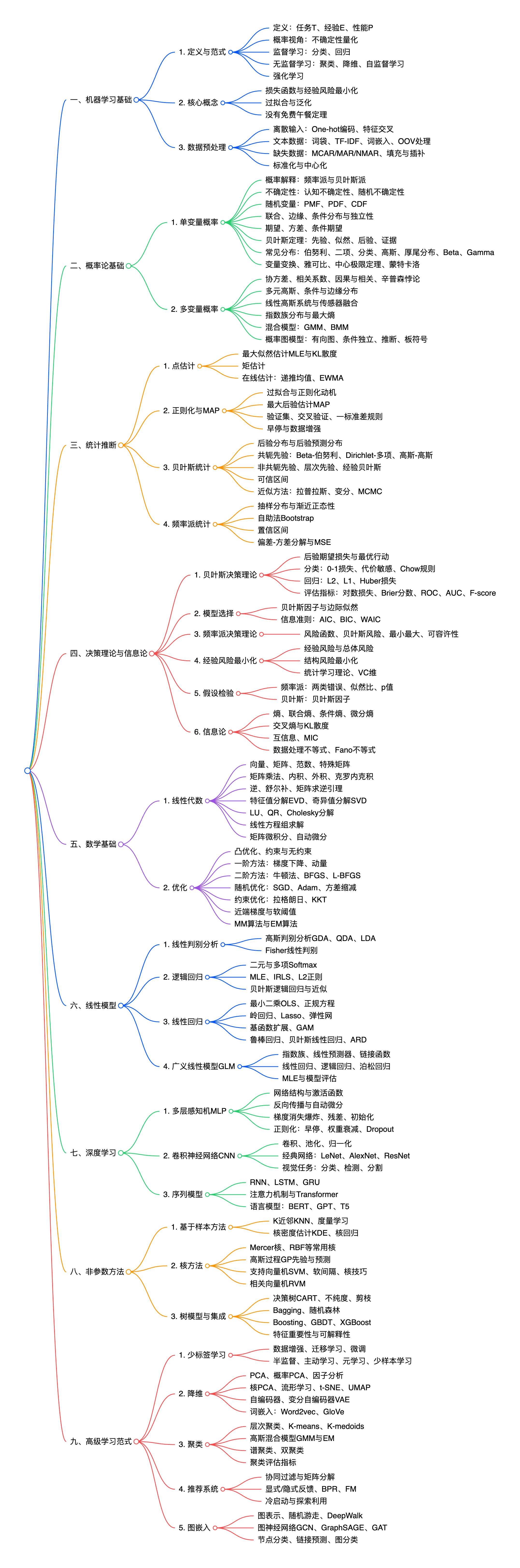

- 第一部分:基础(概率、统计、决策论、信息论、线性代数、优化)。

- 第二部分:线性模型(LDA、逻辑回归、线性回归、GLM)。

- 第三部分:深度神经网络(MLP、CNN、RNN)。

- 第四部分:非参数模型(KNN、核方法、树模型)。

- 第五部分:超越监督学习(少样本学习、降维、聚类、推荐系统、图嵌入)。

1.6.3 注意事项

- 奖励黑客:优化给定的损失函数可能未捕获真实偏好。

- 对齐问题:需确保AI系统目标与人类价值观一致。

- 增强智能:将AI视为辅助工具,保持人类在决策循环中。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 分类 | Iris数据集,用花瓣长度区分Setosa |

| 回归 | 用线性回归预测温度 |

| 过拟合 | 多项式回归次数过高导致摆动 |

| One-hot编码 | 颜色[红,绿,蓝] → (1,0,0), (0,1,0), (0,0,1) |

| TF-IDF | 降低“the”的权重,提高“COVID”的权重 |

| 词嵌入 | 词向量相加得到句子向量用于分类 |

前后章节联系

- 概率基础:本章强调概率视角,为第2-3章概率论做铺垫。

- 线性模型:逻辑回归、线性回归是后续线性模型章节的核心。

- 深度学习:本章简要介绍DNN,为第三部分深入讲解奠定基础。

- 非参数方法:KNN、核方法等将在第四部分详细展开。

- 模型评估:泛化、过拟合等概念在第四、五章反复出现。

本章核心要点

- 机器学习三范式:监督学习、无监督学习、强化学习。

- 监督学习核心:分类与回归,损失函数,经验风险最小化,最大似然估计。

- 概率视角:用概率分布量化不确定性,softmax、高斯分布等。

- 泛化问题:过拟合、欠拟合、训练/测试划分。

- 数据预处理:One-hot编码、特征交叉、词嵌入、TF-IDF、缺失数据处理。

- 常见数据集:MNIST, CIFAR, ImageNet, IMDB等。

- 重要定理:没有免费午餐定理(模型选择需考虑领域)。

常见难点

- 理解经验风险最小化与最大似然估计的关系(NLL等价于交叉熵)。

- 区分认知不确定性与随机不确定性。

- 掌握One-hot编码与特征交叉的原理。

- 理解过拟合的成因及如何通过正则化、更多数据缓解。

学习建议

- 动手实践:用Iris数据集尝试简单的分类和回归。

- 阅读后续章节时,反复回顾本章定义。

- 注意概率视角如何贯穿全书,是理解贝叶斯方法和深度学习的关键。

以上是对第1章“Introduction”的详细讲解,涵盖了所有重要概念、原理和实例,并构建了知识体系,说明了前后联系。希望对您的学习有所帮助!

第2章“Probability: Univariate Models”详细讲解

本章是全书概率论基础的开端,聚焦于单变量概率模型。概率论是机器学习的核心语言,理解本章内容对于后续学习统计推断、贝叶斯方法、各种概率模型至关重要。本章从概率的基本哲学开始,逐步引入随机变量、常见分布、数字特征、贝叶斯定理以及随机变量的变换,为读者构建起处理不确定性的数学工具。

2.1 引言

2.1.1 什么是概率?

概率有两种主要解释:

- 频率主义:概率是长期重复试验中事件发生的相对频率。例如,抛一枚公平硬币,出现正面的概率为0.5,意味着如果抛很多次,大约一半是正面。

- 贝叶斯主义:概率表示对某个命题的主观信念强度,是信息的度量,可以用于一次性事件。例如,“明天下雨的概率是30%”表达的是基于当前信息的信念。

本书采用贝叶斯视角,因为它更灵活,能够处理没有长期频率的事件,并且与决策理论自然结合(第5章)。

2.1.2 不确定性的类型

- 认知不确定性(epistemic uncertainty):由于知识缺乏导致的不确定性,可以通过收集更多数据来减少。例如,对模型参数的不确定。

- 随机不确定性(aleatoric uncertainty):数据本身固有的随机性,无法通过更多数据消除。例如,掷骰子的结果。

区分这两种不确定性对于主动学习、决策等非常重要(第19章)。

2.1.3 概率作为逻辑的延伸

概率可以视为布尔逻辑的扩展,用数值表示命题的真假程度。基本规则:

- 事件 $A$ 的概率 $0 \le \Pr(A) \le 1$。

- 对立事件 $\Pr(\overline{A}) = 1 - \Pr(A)$。

- 联合概率 $\Pr(A \land B) = \Pr(A,B)$,若独立则等于 $\Pr(A)\Pr(B)$。

- 并集概率 $\Pr(A \lor B) = \Pr(A) + \Pr(B) - \Pr(A,B)$。

- 条件概率 $\Pr(B|A) = \Pr(A,B) / \Pr(A)$($\Pr(A)>0$)。

- 独立:$\Pr(A,B)=\Pr(A)\Pr(B)$。

- 条件独立:$\Pr(A,B|C)=\Pr(A|C)\Pr(B|C)$。

2.2 随机变量

随机变量是取值不确定的量,记作 $X$,其可能取值的集合称为样本空间 $\mathcal{X}$。

2.2.1 离散随机变量

- 定义:样本空间有限或可数无限。

- 概率质量函数(PMF):$p(x) = \Pr(X=x)$,满足 $0 \le p(x) \le 1$ 且 $\sum_x p(x)=1$。

- 示例:掷一个均匀四面体骰子,$X \in \{1,2,3,4\}$,$p(x)=1/4$。图2.1展示了均匀分布和退化分布(所有质量集中于一点)。

2.2.2 连续随机变量

- 定义:取值于实数区间。

- 累积分布函数(CDF):$P(x) = \Pr(X \le x)$,单调不减,$\lim_{x\to -\infty}P(x)=0$,$\lim_{x\to\infty}P(x)=1$。

- 概率密度函数(PDF):$p(x) = \frac{d}{dx}P(x)$,满足 $p(x) \ge 0$ 且 $\int_{-\infty}^{\infty} p(x)dx = 1$。注意密度可以大于1(如 $\mathcal{N}(0|0,0.1)\approx 4$),但概率是积分值。

- 分位数:对于 $q \in [0,1]$,$P^{-1}(q)$ 是第 $q$ 分位数。中位数是 $P^{-1}(0.5)$,四分位数是 $P^{-1}(0.25)$ 和 $P^{-1}(0.75)$。

- 示例:标准正态分布 $\mathcal{N}(0,1)$ 的CDF和PDF如图2.2所示。

2.2.3 多个相关随机变量

- 联合分布:$p(x,y)$ 描述两个随机变量同时取值的概率(对离散)或密度(对连续)。

- 边缘分布:$p(x) = \sum_y p(x,y)$(离散)或 $p(x) = \int p(x,y)dy$(连续)。这是求和规则或全概率规则。

- 条件分布:$p(y|x) = p(x,y)/p(x)$。

- 链式法则:$p(x_{1:D}) = p(x_1)p(x_2|x_1)p(x_3|x_1,x_2)\cdots p(x_D|x_{1:D-1})$。

2.2.4 独立性与条件独立性

- 无条件独立:$X \perp Y$ 当且仅当 $p(X,Y)=p(X)p(Y)$。

- 条件独立:$X \perp Y \mid Z$ 当且仅当 $p(X,Y|Z)=p(X|Z)p(Y|Z)$。这是图模型的基础(第3.6节)。

2.2.5 分布的数字特征

- 期望(均值) $\mathbb{E}[X]$:对离散 $\sum x p(x)$,对连续 $\int x p(x) dx$。线性性质:$\mathbb{E}[aX+b]=a\mathbb{E}[X]+b$。

- 方差 $\mathbb{V}[X]$:度量离散程度,$\mathbb{V}[X] = \mathbb{E}[(X-\mu)^2] = \mathbb{E}[X^2] - \mu^2$。

- 标准差 $\sigma = \sqrt{\mathbb{V}[X]}$,与 $X$ 同量纲。

- 众数:使 $p(x)$ 最大的 $x$。

- 条件期望与方差:$\mathbb{E}[X] = \mathbb{E}_Y[\mathbb{E}[X|Y]]$(全期望公式),$\mathbb{V}[X] = \mathbb{E}[\mathbb{V}[X|Y]] + \mathbb{V}[\mathbb{E}[X|Y]]$(全方差公式)。图2.4用高斯混合示例说明方差分解。

2.2.6 摘要统计的局限性

- Anscombe’s quartet(图2.5):四组数据具有相同的均值、方差、相关系数,但分布形态截然不同。

- Datasaurus Dozen(图2.6、2.7):更多示例表明仅靠摘要统计会严重丢失信息,可视化(如小提琴图)很重要。

2.3 贝叶斯定理

贝叶斯定理是逆概率推理的基础:

$$ p(H|Y) = \frac{p(H)p(Y|H)}{p(Y)} $$其中:

- 先验 $p(H)$:在观测数据前对假设 $H$ 的信念。

- 似然 $p(Y|H)$:给定假设,数据出现的概率。

- 证据 $p(Y)$:数据的边缘概率,归一化常数。

- 后验 $p(H|Y)$:更新后的信念。

2.3.1 示例:COVID-19检测

- 设 $H=1$ 表示感染,$H=0$ 未感染。敏感性(TPR)0.875,特异性(TNR)0.975,先验患病率0.1。

- 阳性检测后:$p(H=1|+) \approx 0.795$;阴性后:$p(H=1|-) \approx 0.014$。

- 若患病率降为1%,阳性后仅为26%,体现了先验的影响。

2.3.2 示例:蒙提霍尔问题

- 三个门,一个奖品。你选1号,主持人打开3号(无奖品)。问是否换到2号?

- 先验 $p(H_i)=1/3$,似然取决于主持人行为。

- 计算后验:$p(H_2|3\text{ opened})=2/3$,$p(H_1|3\text{ opened})=1/3$,所以换门胜率翻倍。

2.3.3 逆问题

许多科学问题(如从2D图像推断3D形状)是不适定的,因为多个可能的 $H$ 对应同一观测。贝叶斯定理提供了一种通过先验约束可能解的框架。

2.4 伯努利与二项分布

2.4.1 定义

- 伯努利分布 $\mathrm{Ber}(\theta)$:$Y \in \{0,1\}$,$p(Y=1)=\theta$,$p(Y=0)=1-\theta$。PMF:$\mathrm{Ber}(y|\theta)=\theta^y(1-\theta)^{1-y}$。

- 二项分布 $\mathrm{Bin}(N,\theta)$:$N$ 次独立伯努利试验的成功次数 $S$,PMF:$\mathrm{Bin}(s|N,\theta)=\binom{N}{s}\theta^s(1-\theta)^{N-s}$,其中 $\binom{N}{s}$ 是二项式系数。

2.4.2 Sigmoid(logistic)函数

- Sigmoid:$\sigma(a) = \frac{1}{1+e^{-a}}$,将实数映射到 $[0,1]$,是二分类中概率的自然表示(图2.10)。

- 性质:$\sigma'(a)=\sigma(a)(1-\sigma(a))$,$1-\sigma(a)=\sigma(-a)$,$\sigma^{-1}(p)=\log\frac{p}{1-p}$(logit函数)。

- Softplus:$\mathrm{softplus}(a)=\log(1+e^a)$,导数即为sigmoid。

2.4.3 二元逻辑回归

- 模型:$p(y=1|x;\theta)=\sigma(\mathbf{w}^\top x + b)$,用于二分类。图2.11展示了Iris数据上的决策边界。

2.5 分类与多项分布

2.5.1 定义

- 分类分布 $\mathrm{Cat}(\theta)$:$K$ 个类别,$p(y=c|\theta)=\theta_c$,满足 $\sum \theta_c=1$。用 one-hot 向量 $y$ 可写为 $\mathrm{Cat}(y|\theta)=\prod_c \theta_c^{y_c}$。

- 多项分布 $\mathcal{M}(N,\theta)$:$N$ 次独立分类试验,各类出现次数 $y_c$ 的分布:$\mathcal{M}(y|N,\theta)=\binom{N}{y_1\ldots y_C}\prod_c \theta_c^{y_c}$。

2.5.2 Softmax函数

- Softmax:$\mathrm{softmax}(\mathbf{a})_c = \frac{e^{a_c}}{\sum_{c'} e^{a_{c'}}}$,将实数向量(logits)映射为概率向量。当温度 $T\to 0$ 时,趋近于 argmax(winner-take-all);$T$ 大时趋于均匀(图2.12)。

2.5.3 多类逻辑回归

- 模型:$p(y=c|x)=\mathrm{softmax}_c(\mathbf{W}x + \mathbf{b})$。对于二分类,退化为 sigmoid(差一个logit)。图2.13展示Iris数据的线性决策边界。

2.5.4 Log-Sum-Exp技巧

- 计算 softmax 时可能数值溢出。利用 $\log\sum\exp(a_c)=m+\log\sum\exp(a_c-m)$,取 $m=\max a_c$ 保证数值稳定。定义 $\mathrm{lse}(\mathbf{a})$,则 $p_c = \exp(a_c - \mathrm{lse}(\mathbf{a}))$。

2.6 单变量高斯(正态)分布

- PDF:$\mathcal{N}(y|\mu,\sigma^2) = \frac{1}{\sqrt{2\pi\sigma^2}} e^{-\frac{1}{2\sigma^2}(y-\mu)^2}$。

- CDF:$\Phi(y;\mu,\sigma^2) = \int_{-\infty}^y \mathcal{N}(z|\mu,\sigma^2)dz$,常用误差函数 $\mathrm{erf}$ 计算。

- 分位数:95%区间约为 $\mu \pm 1.96\sigma \approx \mu \pm 2\sigma$。

- 回归中的应用:线性回归假设 $p(y|x)=\mathcal{N}(y|\mathbf{w}^\top x + b, \sigma^2)$,可扩展为异方差回归(方差依赖于输入)(图2.14)。

- 为什么常用?:

- 易于解释(均值和方差)。

- 中心极限定理保证和分布趋近高斯。

- 最大熵性质(给定均值和方差时)。

- 数学方便。

- Dirac delta函数:$\lim_{\sigma\to0}\mathcal{N}(y|\mu,\sigma^2)=\delta(y-\mu)$,是概率的极限情况。

- 截断高斯:限制在区间 $[a,b]$ 内的高斯。

2.7 其他常见单变量分布 *

2.7.1 Student-t分布

- PDF:$\mathcal{T}(y|\mu,\sigma^2,\nu) \propto \left[1+\frac{1}{\nu}\left(\frac{y-\mu}{\sigma}\right)^2\right]^{-(\nu+1)/2}$。

- 特点:厚尾,对离群点鲁棒(图2.16)。$\nu \to \infty$ 时趋近高斯。均值存在需 $\nu>1$,方差存在需 $\nu>2$。

2.7.2 Cauchy分布

- $\nu=1$ 时的特例,PDF:$\mathcal{C}(x|\mu,\gamma)=\frac{1}{\pi\gamma}\left[1+\left(\frac{x-\mu}{\gamma}\right)^2\right]^{-1}$。尾部极厚,均值方差无定义。

2.7.3 Laplace分布

- PDF:$\mathrm{Laplace}(y|\mu,b)=\frac{1}{2b}\exp\left(-\frac{|y-\mu|}{b}\right)$。比高斯厚尾,用于鲁棒回归(第11.6节)和稀疏诱导(L1正则化,第11.4节)。

2.7.4 Beta分布

- PDF:$\mathrm{Beta}(x|a,b) = \frac{1}{B(a,b)} x^{a-1}(1-x)^{b-1}$,支持域 $[0,1]$,用于伯努利参数的先验(第4.6节)。$a=b=1$ 时均匀;$a,b>1$ 时单峰;$a,b<1$ 时双峰(图2.17a)。

2.7.5 Gamma分布

- PDF:$\mathrm{Ga}(x|a,b) = \frac{b^a}{\Gamma(a)} x^{a-1}e^{-xb}$,支持域 $x>0$。特例包括指数分布($a=1$)和卡方分布($a=\nu/2,b=1/2$)。逆Gamma用于方差的先验。

2.7.6 经验分布

- 给定样本 $\{x^{(n)}\}$,经验分布 $\hat{p}_N(x)=\frac{1}{N}\sum_{n=1}^N \delta_{x^{(n)}}(x)$,CDF 为阶梯函数(图2.18)。

2.8 随机变量的变换 *

2.8.1 离散情形

- $p_Y(y) = \sum_{x:f(x)=y} p_X(x)$。

2.8.2 连续情形

- 用CDF法:$P_Y(y)=\Pr(Y\le y)=\Pr(f(X)\le y)$。

2.8.3 可逆变换(双射)

- 单变量:若 $y=f(x)$ 单调,$x=g(y)$,则 $p_Y(y)=p_X(g(y))\left|\frac{dg(y)}{dy}\right|$(图2.19a)。

- 多变量:$\mathbf{y}=\mathbf{f}(\mathbf{x})$,$\mathbf{x}=\mathbf{g}(\mathbf{y})$,则 $p_{\mathbf{y}}(\mathbf{y}) = p_{\mathbf{x}}(\mathbf{g}(\mathbf{y})) |\det \mathbf{J}_{\mathbf{g}}(\mathbf{y})|$,其中 $\mathbf{J}_{\mathbf{g}}$ 是雅可比矩阵。图2.20展示了线性变换对方块面积的影响,图2.21展示了极坐标变换。

2.8.4 线性变换的矩

- $\mathbb{E}[\mathbf{A}\mathbf{x}+\mathbf{b}] = \mathbf{A}\mathbb{E}[\mathbf{x}]+\mathbf{b}$。

- $\mathrm{Cov}[\mathbf{A}\mathbf{x}+\mathbf{b}] = \mathbf{A}\mathrm{Cov}[\mathbf{x}]\mathbf{A}^\top$。

- 特别地,$\mathbb{V}[a^\top X+b] = a^\top \mathrm{Cov}[X] a$。

2.8.5 卷积定理

- 若 $Y=X_1+X_2$ 且独立,则 $p_Y(y)=\int p_{X_1}(x_1)p_{X_2}(y-x_1)dx_1$。离散情形为求和(图2.22)。高斯分布的卷积仍是高斯:$\mathcal{N}(\mu_1,\sigma_1^2) \otimes \mathcal{N}(\mu_2,\sigma_2^2) = \mathcal{N}(\mu_1+\mu_2,\sigma_1^2+\sigma_2^2)$。

2.8.6 中心极限定理

- 独立同分布随机变量 $X_1,\ldots,X_N$,均值为 $\mu$,方差 $\sigma^2$,则标准化和 $Z_N = \frac{\sum X_n - N\mu}{\sigma\sqrt{N}}$ 的分布趋近标准正态。图2.23展示Beta分布样本均值的收敛。

2.8.7 蒙特卡洛近似

- 当解析求解困难时,可采样大量 $x^{(s)}\sim p_X(x)$,用经验分布 $\frac{1}{S}\sum_s \delta(y-f(x^{(s)}))$ 近似 $p_Y(y)$(图2.24)。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| PMF | 均匀四面体骰子,$p(x)=1/4$ |

| $\mathcal{N}(0,1)$ 在0处的密度约为0.4 | |

| CDF | 标准正态 $\Phi(1.96)\approx 0.975$ |

| 贝叶斯 | COVID检测:先验10%,阳性后约79.5% |

| 伯努利 | 抛硬币,正面概率 $\theta$ |

| Sigmoid | $\sigma(0)=0.5$ |

| 二项 | 10次抛硬币,3次正面概率 $\binom{10}{3}(0.5)^{10}$ |

| 高斯 | 身高分布,均值170cm,方差10cm² |

| Beta | 作为硬币偏好的先验,$a=2,b=2$ 弱偏好0.5 |

| 卷积 | 两枚骰子和,分布为三角形 |

| 中心极限定理 | 从Beta分布抽样本均值,近似正态 |

前后章节联系

- 第3章(多变量概率):本章单变量概念是基础,第3章推广到多变量,包括协方差、多元高斯、线性高斯系统等。

- 第4章(统计):本章介绍的贝叶斯定理、常见分布是统计推断的基石,如MLE、MAP、共轭先验。

- 第5章(决策论):不确定性量化(后验分布)用于决策。

- 第11章(线性回归):高斯分布在回归中作为噪声模型。

- 第13章(神经网络):sigmoid、softmax作为激活函数,分布假设用于损失函数。

本章核心要点

- 概率的两种解释:频率与贝叶斯,本书采用贝叶斯视角。

- 随机变量与分布:离散用PMF,连续用PDF和CDF。

- 关键操作:边缘化、条件化、独立性。

- 数字特征:期望、方差是分布的核心摘要。

- 贝叶斯定理:更新信念的核心公式,贯穿全书。

- 常见分布:伯努利/二项用于计数,高斯用于连续,Beta/Gamma用于先验,厚尾分布用于鲁棒性。

- 变换:变量替换、卷积、中心极限定理、蒙特卡洛近似是处理衍生随机变量的工具。

常见难点

- 区分概率密度与概率(密度可大于1)。

- 正确应用贝叶斯公式,理解先验、似然、后验的关系。

- 掌握变量替换公式中的雅可比行列式。

- 理解中心极限定理的适用条件和近似质量。

- 区分认知不确定性和随机不确定性。

学习建议

- 多练习手工推导简单分布的数字特征(如Beta的均值和方差)。

- 用Python实现蒙特卡洛近似,直观感受中心极限定理。

- 熟悉常见分布的PDF表达式及其形状,为后续建模打好基础。

- 结合第4章理解共轭先验的概念。

以上是第2章“概率:单变量模型”的详细讲解。希望这份材料能帮助您扎实掌握概率论基础,为后续章节的学习铺平道路。

第3章“Probability: Multivariate Models”详细讲解

本章将概率论从单变量扩展到多变量,为处理多维数据(如特征向量、时间序列、图像)奠定基础。我们引入联合分布、依赖关系的量化(协方差、相关性)、最重要的多元分布——多元高斯,以及构建复杂概率模型的两大工具:线性高斯系统、混合模型和概率图模型。本章内容是后续统计推断、线性模型、图模型等章节的数学基石。

3.1 多个随机变量的联合分布

3.1.1 协方差

- 定义:两个随机变量 $X$ 和 $Y$ 的协方差度量它们的线性相关程度: $$ \mathrm{Cov}[X,Y] = \mathbb{E}[(X-\mathbb{E}[X])(Y-\mathbb{E}[Y])] = \mathbb{E}[XY] - \mathbb{E}[X]\mathbb{E}[Y] $$

- 协方差矩阵:对于 $D$ 维随机向量 $\mathbf{x} = (X_1,\ldots,X_D)^\top$,协方差矩阵为 $$ \mathrm{Cov}[\mathbf{x}] = \mathbb{E}[(\mathbf{x}-\mathbb{E}[\mathbf{x}])(\mathbf{x}-\mathbb{E}[\mathbf{x}])^\top] = \mathbf{\Sigma} $$ 其中 $\Sigma_{ij} = \mathrm{Cov}[X_i,X_j]$,$\Sigma_{ii} = \mathbb{V}[X_i]$。协方差矩阵是对称半正定矩阵。

- 线性变换:$\mathrm{Cov}[\mathbf{A}\mathbf{x} + \mathbf{b}] = \mathbf{A}\mathrm{Cov}[\mathbf{x}]\mathbf{A}^\top$。

3.1.2 相关系数

- Pearson相关系数:归一化的协方差 $$ \rho_{XY} = \frac{\mathrm{Cov}[X,Y]}{\sqrt{\mathbb{V}[X]\mathbb{V}[Y]}} \in [-1,1] $$

- 性质:

- $\rho = \pm 1$ 当且仅当 $Y = aX + b$(线性关系)。

- $\rho = 0$ 表示不相关,但不一定独立(见3.1.3)。

- 相关矩阵:$\mathrm{corr}(\mathbf{x})$ 是 $\mathbf{\Sigma}$ 的对角归一化版本。

3.1.3 不相关 ≠ 独立

- 反例:令 $X \sim U(-1,1)$,$Y = X^2$。则 $Y$ 完全由 $X$ 决定,但 $\mathrm{Cov}[X,Y]=0$。图3.1展示更多例子,强调仅靠相关系数无法捕捉非线性依赖。

3.1.4 相关 ≠ 因果

- 示例:冰激凌销量与暴力犯罪率正相关(图3.2),但实际原因是天气(共同原因)。相关可能是虚假的,不能推断因果。

3.1.5 辛普森悖论

- 现象:分组看趋势与合并后趋势相反。例如,COVID-19死亡率:意大利各年龄组死亡率低于中国,但总体死亡率更高,因为意大利老年人口比例高(图3.3、3.4)。这警示在分析时要考虑混杂变量。

3.2 多元高斯(正态)分布(MVN)

3.2.1 定义

- 概率密度函数: $$ \mathcal{N}(\mathbf{y}|\boldsymbol{\mu},\boldsymbol{\Sigma}) = \frac{1}{(2\pi)^{D/2}|\boldsymbol{\Sigma}|^{1/2}} \exp\left[-\frac{1}{2}(\mathbf{y}-\boldsymbol{\mu})^\top\boldsymbol{\Sigma}^{-1}(\mathbf{y}-\boldsymbol{\mu})\right] $$ 其中 $\boldsymbol{\mu}\in\mathbb{R}^D$ 是均值向量,$\boldsymbol{\Sigma}$ 是协方差矩阵(对称正定)。

- 二维情形: $$ \boldsymbol{\Sigma} = \begin{pmatrix}\sigma_1^2 & \rho\sigma_1\sigma_2 \\ \rho\sigma_1\sigma_2 & \sigma_2^2\end{pmatrix} $$ 图3.5、3.6展示了不同协方差结构(全、对角、球状)的等高线。

3.2.2 马氏距离

- 定义:$\Delta^2 = (\mathbf{y}-\boldsymbol{\mu})^\top\boldsymbol{\Sigma}^{-1}(\mathbf{y}-\boldsymbol{\mu})$。

- 几何意义:通过特征分解 $\boldsymbol{\Sigma} = \mathbf{U}\boldsymbol{\Lambda}\mathbf{U}^\top$,则 $\Delta^2 = \sum_{d=1}^D \frac{z_d^2}{\lambda_d}$,其中 $\mathbf{z} = \mathbf{U}^\top(\mathbf{y}-\boldsymbol{\mu})$。因此马氏距离是旋转后尺度归一化的欧氏距离,等高线为椭球(图7.6)。

3.2.3 条件分布与边缘分布

- 分块:将 $\mathbf{y}$ 分为两部分 $\mathbf{y}_1$($D_1$ 维)和 $\mathbf{y}_2$($D_2$ 维),对应 $$ \boldsymbol{\mu} = \begin{pmatrix}\boldsymbol{\mu}_1 \\ \boldsymbol{\mu}_2\end{pmatrix},\quad \boldsymbol{\Sigma} = \begin{pmatrix}\boldsymbol{\Sigma}_{11} & \boldsymbol{\Sigma}_{12} \\ \boldsymbol{\Sigma}_{21} & \boldsymbol{\Sigma}_{22}\end{pmatrix} $$

- 边缘分布: $$ p(\mathbf{y}_1) = \mathcal{N}(\mathbf{y}_1|\boldsymbol{\mu}_1,\boldsymbol{\Sigma}_{11}),\quad p(\mathbf{y}_2) = \mathcal{N}(\mathbf{y}_2|\boldsymbol{\mu}_2,\boldsymbol{\Sigma}_{22}) $$

- 条件分布: $$ p(\mathbf{y}_1|\mathbf{y}_2) = \mathcal{N}(\mathbf{y}_1|\boldsymbol{\mu}_{1|2},\boldsymbol{\Sigma}_{1|2}) $$ 其中 $$ \boldsymbol{\mu}_{1|2} = \boldsymbol{\mu}_1 + \boldsymbol{\Sigma}_{12}\boldsymbol{\Sigma}_{22}^{-1}(\mathbf{y}_2 - \boldsymbol{\mu}_2) $$ $$ \boldsymbol{\Sigma}_{1|2} = \boldsymbol{\Sigma}_{11} - \boldsymbol{\Sigma}_{12}\boldsymbol{\Sigma}_{22}^{-1}\boldsymbol{\Sigma}_{21} $$

- 示例:2d高斯,给定 $Y_2 = y_2$,条件均值是对 $Y_1$ 的线性预测,方差减小(图3.7)。

- 应用:缺失值插补(图3.7),利用观测变量推断隐藏变量。

3.3 线性高斯系统 *

3.3.1 模型

- 假设: $$ p(\mathbf{z}) = \mathcal{N}(\mathbf{z}|\boldsymbol{\mu}_z,\boldsymbol{\Sigma}_z),\quad p(\mathbf{y}|\mathbf{z}) = \mathcal{N}(\mathbf{y}|\mathbf{W}\mathbf{z}+\mathbf{b},\boldsymbol{\Sigma}_y) $$

- 联合分布是高斯,均值和协方差由上面给出。

3.3.2 贝叶斯规则用于高斯

- 后验: $$ p(\mathbf{z}|\mathbf{y}) = \mathcal{N}(\mathbf{z}|\boldsymbol{\mu}_{z|y},\boldsymbol{\Sigma}_{z|y}) $$ 其中 $$ \boldsymbol{\Sigma}_{z|y}^{-1} = \boldsymbol{\Sigma}_z^{-1} + \mathbf{W}^\top\boldsymbol{\Sigma}_y^{-1}\mathbf{W} $$ $$ \boldsymbol{\mu}_{z|y} = \boldsymbol{\Sigma}_{z|y}\left[\mathbf{W}^\top\boldsymbol{\Sigma}_y^{-1}(\mathbf{y}-\mathbf{b}) + \boldsymbol{\Sigma}_z^{-1}\boldsymbol{\mu}_z\right] $$

- 证据(边际似然): $$ p(\mathbf{y}) = \mathcal{N}(\mathbf{y}|\mathbf{W}\boldsymbol{\mu}_z+\mathbf{b},\;\boldsymbol{\Sigma}_y + \mathbf{W}\boldsymbol{\Sigma}_z\mathbf{W}^\top) $$

3.3.3 例子:推断未知标量

- 观测 $y_i = z + \epsilon_i$,$\epsilon_i \sim \mathcal{N}(0,\sigma^2)$,先验 $z \sim \mathcal{N}(\mu_0,\tau_0^2)$。则后验均值是加权平均:$\mu_N = \frac{N/\sigma^2}{N/\sigma^2 + 1/\tau_0^2} \bar{y} + \frac{1/\tau_0^2}{N/\sigma^2 + 1/\tau_0^2} \mu_0$(图3.8)。

3.3.4 例子:推断未知向量

- 类似标量情形,后验协方差是 $\boldsymbol{\Sigma}_{z|y} = (\boldsymbol{\Sigma}_z^{-1} + N\boldsymbol{\Sigma}_y^{-1})^{-1}$,均值结合先验和观测(图3.9)。

3.3.5 例子:传感器融合

- 多个传感器观测同一未知量,每个传感器有不同噪声。后验结合所有信息,根据各传感器可靠性加权(图3.10)。

3.4 指数族 *

3.4.1 定义

- 概率分布 $p(\mathbf{y}|\boldsymbol{\eta})$ 若可写为

$$

p(\mathbf{y}|\boldsymbol{\eta}) = h(\mathbf{y})\exp\left[\boldsymbol{\eta}^\top\mathcal{T}(\mathbf{y}) - A(\boldsymbol{\eta})\right]

$$

则属于指数族。其中:

- $\boldsymbol{\eta}$:自然参数

- $\mathcal{T}(\mathbf{y})$:充分统计量

- $h(\mathbf{y})$:基测度

- $A(\boldsymbol{\eta})$:对数配分函数(凸函数)

3.4.2 示例

- 伯努利:写成指数族形式 $$ \mathrm{Ber}(y|\mu) = \exp\left[y\log\frac{\mu}{1-\mu} + \log(1-\mu)\right] $$ 此时 $\eta = \log\frac{\mu}{1-\mu}$,$\mathcal{T}(y)=y$,$A(\eta)=\log(1+e^\eta)$。

3.4.3 对数配分函数是累积量生成函数

- $\nabla A(\boldsymbol{\eta}) = \mathbb{E}[\mathcal{T}(\mathbf{y})]$,$\nabla^2 A(\boldsymbol{\eta}) = \mathrm{Cov}[\mathcal{T}(\mathbf{y})]$。因此对数似然是凹函数,MLE唯一。

3.4.4 最大熵推导

- 给定特征的期望约束,最大化熵(或最小化KL)得到指数族分布。例如,给定均值与二阶矩,得到高斯分布。

3.5 混合模型

3.5.1 高斯混合模型(GMM)

- 定义: $$ p(\mathbf{y}|\boldsymbol{\theta}) = \sum_{k=1}^K \pi_k \mathcal{N}(\mathbf{y}|\boldsymbol{\mu}_k,\boldsymbol{\Sigma}_k) $$ 其中 $\pi_k$ 是混合权重($\sum\pi_k=1$)。

- 生成过程:先选成分 $z \sim \mathrm{Cat}(\boldsymbol{\pi})$,再生成 $\mathbf{y} \sim \mathcal{N}(\boldsymbol{\mu}_z,\boldsymbol{\Sigma}_z)$。

- 聚类应用:通过后验责任度 $r_{nk}=p(z=k|\mathbf{y}_n)$ 进行软聚类或硬聚类(图3.12)。

3.5.2 伯努利混合模型(BMM)

- 用于二值数据: $$ p(\mathbf{y}|z=k) = \prod_{d=1}^D \mathrm{Ber}(y_d|\mu_{dk}) $$ 图3.13展示对MNIST二值化数据的聚类,每个成分学习一个“原型”数字。

3.6 概率图模型(PGM)*

3.6.1 表示

- 有向无环图(DAG):节点表示变量,边表示直接依赖。利用条件独立性(给定父节点,变量与所有非后代独立)将联合分布分解为 $$ p(\mathbf{y}_{1:N_G}) = \prod_{i=1}^{N_G} p(y_i|\mathbf{y}_{\mathrm{pa}(i)}) $$

- 示例1:洒水器网络(图3.14): $$ p(C,S,R,W) = p(C)p(S|C)p(R|C)p(W|S,R) $$ 展示了“解释”效应(Berkson悖论)。

- 示例2:马尔可夫链(图3.15): $$ p(y_{1:T}) = p(y_1)\prod_{t=2}^T p(y_t|y_{t-1}) $$ 是语言模型的基础。

3.6.2 推断

- 给定观测,计算其他变量的后验。例如洒水器网络中,观测到草地湿,则雨后验概率改变;再观测到洒水器开,雨后验概率降低(解释效应)。

3.6.3 学习

- 将参数视为随机变量,添加节点。图3.16展示了iid数据和参数的图模型,以及板符号(plate notation)简化表示。图3.17是GMM的图模型表示。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 协方差 | 两个随机变量的线性相关度量 |

| 相关系数 | 冰激凌销量与犯罪率虚假相关 |

| 辛普森悖论 | COVID-19各国死亡率比较 |

| 多元高斯 | 2d高斯等高线(图3.5) |

| 条件高斯 | 给定 $y_2$,$y_1$ 的均值线性依赖(公式3.31) |

| 传感器融合 | 两个噪声不同的传感器融合估计(图3.10) |

| 指数族 | 伯努利、高斯、多项分布 |

| GMM | 鸢尾花数据聚类(图3.12) |

| BMM | MNIST数字原型(图3.13) |

| PGM | 洒水器网络(图3.14) |

前后章节联系

- 第2章(单变量概率):本章是单变量到多变量的自然延伸,协方差、多元高斯都是第2章概念的推广。

- 第4章(统计):线性高斯系统是贝叶斯推断的实例,指数族为广义线性模型(第12章)和共轭先验(第4章)提供框架。

- 第9章(LDA):高斯判别分析基于多元高斯。

- 第11章(线性回归):线性高斯系统是贝叶斯线性回归的基础。

- 第13章及以后:混合模型用于聚类,图模型用于结构化预测。

本章核心要点

- 依赖度量:协方差和相关系数量化线性关系,但不相关 ≠ 独立,相关 ≠ 因果。

- 多元高斯:最常用的多元分布,具有简洁的条件和边缘公式,是许多模型的基础。

- 线性高斯系统:先验和似然均为高斯时,后验解析可求,是贝叶斯滤波、卡尔曼滤波的基石。

- 指数族:统一框架涵盖常见分布,具有凸对数似然和充分统计量性质。

- 混合模型:通过隐变量扩展简单分布,能建模复杂多模态分布。

- 概率图模型:用图表示变量间条件独立关系,提供模块化建模语言。

常见难点

- 理解多元高斯的条件分布公式及其推导(Schur补)。

- 区分相关与独立、相关与因果。

- 掌握指数族中自然参数、充分统计量、对数配分函数的关系。

- 理解混合模型中隐变量的作用及EM算法基础(第8章)。

- 理解图模型中“解释”效应(Berkson悖论)。

学习建议

- 熟练推导2d高斯的条件分布,并用Python可视化。

- 用NumPy实现一个简单的线性高斯系统(如传感器融合)。

- 学习指数族时,将伯努利、高斯、多项分布写成指数族形式并找出对应函数。

- 使用Scikit-learn的GMM进行聚类实践。

- 尝试用pgmpy库构建洒水器网络并进行推断。

以上是第3章“多元概率模型”的详细讲解。掌握本章内容将为后续所有基于概率的机器学习模型打下坚实基础。如有疑问,欢迎继续探讨!

第4章“Statistics”详细讲解

本章是全书从概率论迈向统计推断的关键桥梁。概率论(第2-3章)告诉我们如何描述不确定性,而统计学则教我们如何从数据中学习(即参数估计)以及如何量化估计的不确定性。本章将介绍多种参数估计方法,从经典的最大似然估计(MLE)到正则化的最大后验估计(MAP),再到全面的贝叶斯推断,并与频率派统计的偏差-方差权衡进行对比。这些内容是后续所有模型(线性模型、神经网络等)的基础。

4.1 引言

- 目标:从数据 $\mathcal{D}$ 中估计概率模型的参数 $\theta$。

- 一般形式:优化问题 $\hat{\theta} = \arg\min \mathcal{L}(\theta)$,其中 $\mathcal{L}(\theta)$ 是损失函数。

- 推断:除了点估计 $\hat{\theta}$,还要量化对 $\theta$ 的置信度。本章讨论贝叶斯和频率派两种推断框架。

4.2 最大似然估计(MLE)

4.2.1 定义

- MLE:选择使观测数据概率最大的参数: $$ \hat{\theta}_{\mathrm{mle}} = \arg\max_{\theta} p(\mathcal{D}|\theta) $$

- i.i.d.假设:数据独立同分布,则 $$ p(\mathcal{D}|\theta) = \prod_{n=1}^N p(\mathbf{y}_n|\mathbf{x}_n,\theta) $$ 对于无监督学习,为 $\prod p(\mathbf{y}_n|\theta)$。

- 对数似然:$\ell(\theta) = \log p(\mathcal{D}|\theta) = \sum_{n=1}^N \log p(\mathbf{y}_n|\mathbf{x}_n,\theta)$,便于计算和优化。

- 负对数似然(NLL):$\mathrm{NLL}(\theta) = -\ell(\theta)$,最小化NLL等价于最大化似然。

4.2.2 MLE的合理性

- 贝叶斯视角:若先验 $p(\theta) \propto 1$(均匀),则MAP估计(见4.5)退化为MLE。

- KL散度视角:最小化模型分布与经验分布之间的KL散度等价于最小化NLL。即: $$ D_{\mathrm{KL}}(p_{\mathcal{D}} \| p_{\theta}) = \text{const} + \mathrm{NLL}(\theta) $$ 因此MLE使模型尽可能接近经验分布。

4.2.3 示例:伯努利分布的MLE

- 数据:$N$ 次抛硬币,$N_1$ 次正面,$N_0$ 次反面。

- NLL:$-\left[N_1\log\theta + N_0\log(1-\theta)\right]$。

- 导数:$\frac{d}{d\theta}\mathrm{NLL} = -\frac{N_1}{\theta} + \frac{N_0}{1-\theta} = 0$ → $\hat{\theta}_{\mathrm{mle}} = N_1/(N_0+N_1)$。

- 解释:就是正面的经验频率。

4.2.4 示例:分类分布的MLE

- 数据:$N$ 次掷 $K$ 面骰子,$N_k$ 为第 $k$ 面出现次数。

- NLL:$-\sum_k N_k\log\theta_k$,约束 $\sum_k\theta_k=1$。

- 用拉格朗日乘子法得 $\hat{\theta}_k = N_k/N$。

4.2.5 示例:单变量高斯的MLE

- 模型:$\mathcal{N}(y|\mu,\sigma^2)$。

- NLL:$\frac{1}{2\sigma^2}\sum_n (y_n-\mu)^2 + \frac{N}{2}\log(2\pi\sigma^2)$。

- 求导得:$\hat{\mu} = \frac{1}{N}\sum_n y_n$,$\hat{\sigma}^2 = \frac{1}{N}\sum_n (y_n-\hat{\mu})^2$。

4.2.6 示例:多元高斯的MLE

- 数据矩阵 $\mathbf{Y}\in\mathbb{R}^{N\times D}$,均值向量 $\hat{\boldsymbol{\mu}} = \frac{1}{N}\sum_n \mathbf{y}_n$。

- 协方差矩阵MLE:$\hat{\boldsymbol{\Sigma}} = \frac{1}{N}\sum_n (\mathbf{y}_n-\hat{\boldsymbol{\mu}})(\mathbf{y}_n-\hat{\boldsymbol{\mu}})^\top$。

- 问题:当 $N < D$ 时,$\hat{\boldsymbol{\Sigma}}$ 奇异,且估计不稳定。

4.2.7 示例:线性回归的MLE

- 模型:$p(y|\mathbf{x}) = \mathcal{N}(y|\mathbf{w}^\top\mathbf{x},\sigma^2)$。

- NLL忽略常数后等价于残差平方和 $\mathrm{RSS}(\mathbf{w}) = \sum_n (y_n-\mathbf{w}^\top\mathbf{x}_n)^2$。

- 矩阵形式:$\mathrm{RSS}(\mathbf{w}) = \|\mathbf{X}\mathbf{w} - \mathbf{y}\|^2$。

- 解:$\hat{\mathbf{w}}_{\mathrm{mle}} = (\mathbf{X}^\top\mathbf{X})^{-1}\mathbf{X}^\top\mathbf{y}$(普通最小二乘)。

4.3 经验风险最小化(ERM)

- 推广:将负对数似然替换为任意损失函数: $$ \mathcal{L}(\theta) = \frac{1}{N}\sum_{n=1}^N \ell(y_n,\theta;\mathbf{x}_n) $$

- 示例:分类任务中用0-1损失,但0-1损失非凸且难优化,常用代理损失(surrogate loss),如铰链损失(hinge)或对数损失(log loss)(图4.2)。

4.4 其他估计方法 *

4.4.1 矩估计法(MOM)

- 思想:令理论矩(如 $\mathbb{E}[X^k]$)等于样本矩,解方程得参数。

- 优点:计算简单;缺点:统计效率低,可能得到无效估计(如均匀分布例)。

- 示例:高斯分布,一阶矩 $\mu = \bar{y}$,二阶矩 $\sigma^2 + \mu^2 = \frac{1}{N}\sum y_n^2$ → $\hat{\sigma}^2 = \frac{1}{N}\sum (y_n-\bar{y})^2$,与MLE相同。

- 均匀分布例:$U(\theta_1,\theta_2)$,矩估计可能使 $\hat{\theta}_2 < \max y_n$,不合理;MLE则取 $\hat{\theta}_1 = \min y_n$,$\hat{\theta}_2 = \max y_n$。

4.4.2 在线(递推)估计

- 递推均值:$\hat{\mu}_t = \hat{\mu}_{t-1} + \frac{1}{t}(y_t - \hat{\mu}_{t-1})$。

- 指数加权移动平均(EWMA):$\hat{\mu}_t = \beta \hat{\mu}_{t-1} + (1-\beta) y_t$,可加入偏差校正(图4.3)。

4.5 正则化

4.5.1 动机:过拟合

- MLE可能完美拟合训练数据,但泛化差。例如抛硬币3次全正面,MLE预测 $\theta=1$,未来不会再出现反面,显然不合理。

- 正则化:对复杂模型施加惩罚,优化目标: $$ \mathcal{L}(\theta;\lambda) = \frac{1}{N}\sum_{n=1}^N \ell(y_n,\theta;\mathbf{x}_n) + \lambda C(\theta) $$ 其中 $\lambda \ge 0$ 控制惩罚强度。

- 概率解释:若 $C(\theta) = -\log p(\theta)$,则正则化等价于最大后验估计(MAP): $$ \hat{\theta}_{\mathrm{map}} = \arg\max_{\theta} \left[ \log p(\mathcal{D}|\theta) + \log p(\theta) \right] $$

4.5.2 示例:伯努利的MAP(Beta先验)

- 先验 $p(\theta) = \mathrm{Beta}(\theta|a,b)$,则后验 $\propto \theta^{N_1+a-1}(1-\theta)^{N_0+b-1}$。

- MAP估计:$\hat{\theta}_{\mathrm{map}} = \frac{N_1+a-1}{N_0+N_1+a+b-2}$。

- 若 $a=b=2$,得加一平滑:$\hat{\theta} = \frac{N_1+1}{N+2}$,避免零计数问题。

4.5.3 示例:多元高斯的MAP(收缩估计)

- 对协方差矩阵使用逆Wishart先验,MAP估计为 $$ \hat{\boldsymbol{\Sigma}}_{\mathrm{map}} = \lambda \boldsymbol{\Sigma}_0 + (1-\lambda) \hat{\boldsymbol{\Sigma}}_{\mathrm{mle}} $$ 其中 $\boldsymbol{\Sigma}_0$ 可取对角矩阵。这使非对角线元素向0收缩,保证正定性(图4.4)。

4.5.4 示例:权重衰减($\ell_2$ 正则化)

- 线性回归中,使用高斯先验 $p(\mathbf{w}) = \mathcal{N}(\mathbf{w}|\mathbf{0},\tau^2\mathbf{I})$,得 $$ \hat{\mathbf{w}}_{\mathrm{map}} = \arg\min \mathrm{NLL}(\mathbf{w}) + \lambda \|\mathbf{w}\|_2^2 $$ 称为岭回归。图4.5展示多项式回归中正则化减少过拟合。

4.5.5 选择正则化参数 $\lambda$

- 验证集法:将数据分为训练集和验证集,对每个 $\lambda$ 在训练集上训练,在验证集上评估性能,选最优 $\lambda$。

- 交叉验证(CV):将训练数据分成 $K$ 折,轮流用 $K-1$ 折训练,1折验证,平均验证误差。图4.6展示5折CV。

- 一标准差规则:在CV误差曲线中,选择误差不超过最佳模型一个标准差的最简单模型。

- 示例:岭回归中 $\lambda$ 的选择,图4.7展示CV误差曲线与最优值。

4.5.6 早停

- 在迭代优化过程中,当验证集误差开始上升时停止训练,相当于隐式正则化(图4.8)。

4.5.7 使用更多数据

- 随着数据量增加,过拟合风险降低。学习曲线(图4.9)显示测试误差随 $N$ 下降,最终趋于贝叶斯误差。

4.6 贝叶斯统计 *

4.6.1 贝叶斯推断框架

- 后验:$p(\theta|\mathcal{D}) = \frac{p(\theta)p(\mathcal{D}|\theta)}{p(\mathcal{D})}$,其中 $p(\mathcal{D}) = \int p(\theta)p(\mathcal{D}|\theta)d\theta$ 是边际似然。

- 后验预测:对新数据 $\tilde{\mathbf{y}}$, $$ p(\tilde{\mathbf{y}}|\mathbf{x},\mathcal{D}) = \int p(\tilde{\mathbf{y}}|\mathbf{x},\theta)p(\theta|\mathcal{D})d\theta $$ 这相当于贝叶斯模型平均,可避免过拟合。

4.6.2 共轭先验

- 定义:先验与后验属于同一分布族。

- Beta-伯努利模型:

- 先验 $p(\theta) = \mathrm{Beta}(\theta|a,b)$,似然 $\mathrm{Ber}(y|\theta)$。

- 后验 $\mathrm{Beta}(\theta|a+N_1,b+N_0)$(图4.10)。

- 后验均值:$\mathbb{E}[\theta|\mathcal{D}] = \frac{a+N_1}{a+b+N}$,是先验均值与MLE的凸组合。

- 后验预测:$p(y=1|\mathcal{D}) = \frac{a+N_1}{a+b+N}$(即后验均值)。

- 边际似然:$p(\mathcal{D}) = \frac{B(a+N_1,b+N_0)}{B(a,b)}$(忽略组合数)。

- Dirichlet-多项模型:

- 先验 $\mathrm{Dir}(\boldsymbol{\theta}|\boldsymbol{\alpha})$,似然 $\mathrm{Cat}(y|\boldsymbol{\theta})$。

- 后验 $\mathrm{Dir}(\boldsymbol{\theta}|\boldsymbol{\alpha} + \mathbf{N})$,后验均值 $\bar{\theta}_k = \frac{\alpha_k + N_k}{\sum(\alpha_k+N_k)}$。

- 高斯-高斯模型(已知方差):

- 先验 $\mathcal{N}(\mu|m_0,\tau_0^2)$,似然 $\mathcal{N}(y|\mu,\sigma^2)$。

- 后验 $\mathcal{N}(\mu|m_N,\tau_N^2)$,其中 $$ \tau_N^{-2} = \tau_0^{-2} + N\sigma^{-2},\quad m_N = \tau_N^2\left(\frac{m_0}{\tau_0^2} + \frac{N\bar{y}}{\sigma^2}\right) $$

4.6.3 非共轭先验

- 无信息先验:如 $p(\mu)\propto 1$,但需小心(可能不是良定义)。

- 层次先验:对超参数再设先验,如 $\xi \to \theta \to \mathcal{D}$。

- 经验贝叶斯(EB):用边际似然估计超参数 $\hat{\xi} = \arg\max p(\mathcal{D}|\xi)$,然后代入计算后验 $p(\theta|\hat{\xi},\mathcal{D})$。

4.6.4 可信区间

- 定义:后验分布中覆盖 $1-\alpha$ 概率的区域。常用中心区间(等尾)或最高后验密度(HPD)区间(图4.18、4.19)。

- 与频率派置信区间区别:可信区间是对参数的概率陈述(给定数据),而置信区间是长期频率覆盖。

4.6.5 贝叶斯机器学习

- 对监督学习,后验 $p(\theta|\mathcal{D})$ 综合了先验和数据,预测时积分掉 $\theta$。

- 示例:1d逻辑回归,贝叶斯后验给出决策边界的不确定性(图4.20)。

- 示例:二元输入、标量输出(如两家快递公司),贝叶斯方法能捕捉方差不确定性,而插件估计(只用MLE)可能低估(图4.21)。

4.6.6 计算问题

- 精确后验仅对共轭模型可行,一般需近似:

- 网格近似(低维)

- 拉普拉斯近似(高斯近似于众数,图4.22)

- 变分推断

- MCMC(如HMC)

4.7 频率派统计 *

4.7.1 抽样分布

- 将数据视为随机,$\hat{\theta} = \hat{\Theta}(\mathcal{D})$ 是随机变量,其分布称为抽样分布。

- 例:多次重复采样数据集,计算MLE,观察分布。

4.7.2 MLE的渐近正态性

- 当 $N$ 大时,$\hat{\theta}_{\mathrm{mle}} \approx \mathcal{N}(\theta^*, [N\mathbf{F}(\theta^*)]^{-1})$,其中 $\mathbf{F}(\theta^*)$ 是Fisher信息矩阵(对数似然的曲率)。

4.7.3 自助法(Bootstrap)

- 对原始数据集进行有放回重采样,生成多个“自助样本”,计算估计量,用经验分布近似抽样分布(图4.23)。

- 自助法 vs 贝叶斯后验:自助法可视为“穷人贝叶斯”,两者分布相似,但自助法计算量更大。

4.7.4 置信区间

- 定义:一个随机区间 $I(\mathcal{D})$,使得 $\Pr(\theta^* \in I(\tilde{\mathcal{D}}) | \tilde{\mathcal{D}}\sim\theta^*) \ge 1-\alpha$。

- 近似:若抽样分布近似正态,则 $\hat{\theta} \pm z_{\alpha/2}\hat{\mathrm{se}}$。

- 重要区别:置信区间不是对当前数据集 $\theta$ 的概率陈述,而是对过程的覆盖频率。存在反直觉例子(如贝叶斯示例4.7.5)。

4.7.5 偏差-方差权衡

- 偏差:$\mathrm{bias}(\hat{\theta}) = \mathbb{E}[\hat{\theta}] - \theta^*$。

- 方差:$\mathbb{V}[\hat{\theta}]$。

- 均方误差(MSE):$\mathbb{E}[(\hat{\theta}-\theta^*)^2] = \mathrm{bias}^2 + \mathrm{variance}$。

- 示例:高斯均值估计,MLE无偏但方差大;MAP有偏但方差小,可能在MSE上更优(图4.24)。

- 在回归中:模型复杂度与偏差-方差关系(图4.25、4.26)。复杂模型低偏差高方差,简单模型高偏差低方差,最优是平衡。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| MLE | 抛硬币得 $\hat{\theta}=$ 正面比例 |

| 过拟合 | 多项式次数过高导致摆动(图1.7) |

| 正则化 | 岭回归(图4.5) |

| MAP | Beta(2,2)先验→加一平滑 |

| 贝叶斯后验 | Beta-伯努利更新(图4.10) |

| 后验预测 | 未来抛硬币概率 $\frac{N_1+1}{N+2}$ |

| 置信区间 | 均值估计 $\bar{y} \pm 2\sigma/\sqrt{N}$ |

| 偏差-方差 | 高斯均值估计(图4.24) |

前后章节联系

- 第2-3章:概率分布是统计的基础,本章使用它们构建似然和先验。

- 第5章:决策理论利用后验分布做最优决策,可信区间用于风险评估。

- 第8章:优化算法用于计算MLE/MAP。

- 第10、11章:逻辑回归、线性回归的MLE和MAP估计。

- 第17章:高斯过程(非参数贝叶斯)是贝叶斯方法的延伸。

- 第20章:概率PCA(PPCA)是贝叶斯因子模型。

本章核心要点

- 点估计方法:MLE(最小化NLL),MAP(加入先验正则化)。

- 过拟合与正则化:正则化是控制模型复杂度的关键,包括 $\ell_2$(权重衰减)、$\ell_1$(稀疏)、早停等。

- 贝叶斯推断:用后验分布量化不确定性,共轭先验使计算简洁,后验预测避免过拟合。

- 频率派推断:抽样分布、置信区间、偏差-方差权衡是频率派核心概念。

- 模型选择:交叉验证、边际似然、BIC等信息准则。

- 贝叶斯 vs 频率派:贝叶斯将参数视为随机变量,提供概率解释;频率派关注估计量的长期行为。

常见难点

- 理解MLE的合理性(与KL最小化等价)。

- 区分先验、似然、后验、证据。

- 理解共轭先验如何简化计算(伪计数解释)。

- 区分可信区间与置信区间。

- 理解偏差-方差分解及其实践含义(如正则化影响)。

- 掌握自助法的原理及其与贝叶斯的联系。

学习建议

- 动手实现Beta-伯努利更新,观察后验变化。

- 用线性回归实验,观察正则化强度对权重的影响。

- 模拟数据,计算MLE的抽样分布并与渐近正态比较。

- 用交叉验证选择岭回归的 $\lambda$,并与BIC选择比较。

- 阅读第5章,将统计推断与决策联系起来。

以上是第4章“统计”的详细讲解。本章内容丰富,是全书承上启下的核心章节。掌握本章内容将为后续所有概率模型的建立与评估打下坚实基础。如有疑问,欢迎继续探讨!

第5章“Decision Theory”详细讲解

决策理论是机器学习的核心,它将概率模型(第2-4章)与实际行动联系起来。第4章讨论了如何从数据中学习参数(点估计或分布),但最终我们往往需要根据这些知识做出决策。本章将介绍如何在不确定情况下选择最优行动,包括贝叶斯决策理论、模型选择、频率派决策理论以及假设检验。理解这些内容将帮助我们更好地评估模型、选择模型并做出可靠预测。

5.1 贝叶斯决策理论

5.1.1 基础

- 决策者:需要从一组可能行动 $\mathcal{A}$ 中选择一个。

- 状态:未知的真实世界状态 $H \in \mathcal{H}$(如疾病状态)。

- 损失函数 $\ell(h,a)$:采取行动 $a$ 而真实状态为 $h$ 时所付出的代价。

- 后验期望损失(风险):给定观测数据 $\mathbf{x}$,选择行动 $a$ 的期望损失: $$ \rho(a|\mathbf{x}) = \mathbb{E}_{p(h|\mathbf{x})}[\ell(h,a)] = \sum_{h\in\mathcal{H}} \ell(h,a)p(h|\mathbf{x}) $$

- 最优策略(贝叶斯决策规则): $$ \pi^*(\mathbf{x}) = \arg\min_{a\in\mathcal{A}} \rho(a|\mathbf{x}) $$

- 等价形式:定义效用函数 $U(h,a) = -\ell(h,a)$,则最优策略最大化期望效用。

实例:COVID-19治疗决策

| 状态 | 行动:不给药 | 行动:给药 |

|---|---|---|

| 年轻,无病 | 0 | 8 |

| 年轻,有病 | 60 | 8 |

| 年老,无病 | 0 | 8 |

| 年老,有病 | 10 | 8 |

根据后验概率(来自检测结果)和损失矩阵,计算每种行动的期望损失,选择最小的。表5.2展示了不同情况下的最优行动。

5.1.2 分类问题

5.1.2.1 0-1损失

- 状态为类别 $y \in \{1,\ldots,C\}$,行动也为类别。

- 0-1损失:$\ell_{01}(y,\hat{y}) = \mathbb{I}(y \neq \hat{y})$。

- 后验期望损失:$\rho(\hat{y}|\mathbf{x}) = 1 - p(\hat{y}|\mathbf{x})$。

- 最优行动:选择最大后验概率的类别(MAP决策)。

5.1.2.2 代价敏感分类

- 对于二分类,损失矩阵为 $\begin{pmatrix}\ell_{00} & \ell_{01} \\ \ell_{10} & \ell_{11}\end{pmatrix}$。若 $\ell_{00}=\ell_{11}=0$,则决策阈值为 $\frac{\ell_{01}}{\ell_{01}+\ell_{10}}$。例如,若假阴性代价是假阳性的2倍($\ell_{10}=2\ell_{01}$),则阈值取 $1/3$。

5.1.2.3 带“拒绝”选项的分类

- 增加一个“拒绝”行动(不分类),损失为 $\lambda_r$,分类错误损失为 $\lambda_e$。

- 最优策略:若最大后验概率 $p^* < 1 - \lambda_r/\lambda_e$,则拒绝;否则选择最可能类别(Chow规则,图5.1)。

5.1.3 ROC曲线

- 混淆矩阵:二分类问题中,根据阈值得到TP、FP、TN、FN。

- TPR(真阳性率) = 灵敏度 = $\frac{TP}{TP+FN}$。

- FPR(假阳性率) = $ \frac{FP}{FP+TN}$。

- ROC曲线:绘制TPR vs FPR,随阈值变化(图5.2a)。

- AUC:曲线下面积,越大越好。

- EER:等错误率,即FPR=FNR时的值。

5.1.4 精确率-召回率曲线

- 适用于不平衡数据或不确定“负类”的情形。

- 精确率 $P = \frac{TP}{TP+FP}$。

- 召回率 $R = \frac{TP}{TP+FN}$(同TPR)。

- PR曲线:精确率 vs 召回率(图5.2b)。

- 平均精度(AP):曲线下面积。

- F-score:$F_\beta = (1+\beta^2)\frac{P\cdot R}{\beta^2 P + R}$,$F_1$ 是调和平均。

5.1.5 回归问题

- L2损失(平方损失):最优估计为后验均值(MMSE估计)。

- L1损失(绝对损失):最优估计为后验中位数。

- Huber损失:结合L2(小误差)和L1(大误差),鲁棒且可导(图5.3)。

5.1.6 概率预测问题

- KL散度:衡量预测分布 $q$ 与真实分布 $p$ 的差异,最小化KL等价于最小化交叉熵。

- 对数损失:当真实分布为独热时,交叉熵退化为负对数似然。

- Brier分数:均方误差形式的评分规则,对极端概率不敏感。

5.2 选择“正确”的模型

5.2.1 贝叶斯假设检验

- 比较两个模型 $M_0$ 和 $M_1$,用贝叶斯因子: $$ B_{1,0} = \frac{p(\mathcal{D}|M_1)}{p(\mathcal{D}|M_0)} $$

- Jeffreys尺度:表5.6给出了BF大小的解释。

- 示例:硬币是否公平:$M_0:\theta=0.5$,$M_1:\theta\sim\mathrm{Beta}(\alpha,\alpha)$。图5.4显示边际似然随正面数变化。

5.2.2 贝叶斯模型选择

- 多个模型,选择后验概率最大的: $$ \hat{m} = \arg\max_m p(\mathcal{D}|m)p(m) $$

- 边际似然 $p(\mathcal{D}|m) = \int p(\theta|m)p(\mathcal{D}|\theta,m)d\theta$。

- 示例:多项式回归,图5.5-5.6显示随着数据量增加,后验倾向于更复杂的模型。

5.2.3 奥卡姆剃刀

- 复杂模型将概率质量分散到更多数据集上,因此对特定数据集分配的概率较低(图5.7)。边际似然自然惩罚复杂度。

5.2.4 交叉验证与边际似然的联系

- 边际似然可写为序贯预测乘积,近似于留一交叉验证的对数似然之和。

5.2.5 信息准则

- BIC:$-2\log p(\mathcal{D}|\hat{\theta}) + d\log N$(大样本近似边际似然)。

- AIC:$-2\log p(\mathcal{D}|\hat{\theta}) + 2d$。

- MDL:两阶段编码长度,与BIC形式相同。

- WAIC:适用于奇异模型,使用后验样本计算预期对数点预测密度和复杂度惩罚。

5.2.6 效应大小的后验推断

- 关注实际显著性,而非仅假设检验。定义实际等效区间(ROPE) $[-ϵ,ϵ]$,计算 $p(Δ∈ROPE)$、$p(Δ>ϵ)$、$p(Δ<-ϵ)$。

- 贝叶斯t检验:用于配对数据,后验为Student分布。

- 贝叶斯χ²检验:用于比较两个比例,后验通过数值积分。

5.3 频率派决策理论

5.3.1 计算估计量的风险

- 频率派风险:$R(\theta,\delta) = \mathbb{E}_{p(\mathbf{x}|\theta)}[\ell(\theta,\delta(\mathbf{x}))]$。

- 示例:估计高斯均值,比较样本均值、中位数、固定估计、后验均值(图5.8)。

- 贝叶斯风险:对 $\theta$ 取平均 $R_\pi(\delta) = \mathbb{E}_\pi[R(\theta,\delta)]$,最小化贝叶斯风险得到贝叶斯估计量。

- 最大风险:$R_{\max}(\delta) = \sup_\theta R(\theta,\delta)$,最小化最大风险得到最小最大估计量(图5.9)。

5.3.2 一致估计量

- 随着样本量增加,估计量依概率收敛到真值。MLE是一致估计。

5.3.3 可容许估计量

- 若不存在另一个估计量风险处处不大于它且至少一处严格小,则该估计量可容许。所有可容许估计量都是某种贝叶斯估计量(在某些先验下)。

5.4 经验风险最小化

5.4.1 经验风险

- 总体风险:$R(f) = \mathbb{E}_{p^*(x,y)}[\ell(y,f(x))]$。

- 经验风险:$R(f,\mathcal{D}) = \frac{1}{N}\sum_{n=1}^N \ell(y_n,f(x_n))$。

- 经验风险最小化(ERM):$\hat{f}_{\mathrm{ERM}} = \arg\min_{f\in\mathcal{H}} R(f,\mathcal{D})$。

5.4.1.1 近似误差与估计误差

- 总体最优 $f^{**}$,假设空间最优 $f^*_{\mathcal{H}}$,经验最优 $f^*_{\mathcal{D}}$。

- 期望风险分解:$ \mathbb{E}[R(f^*_{\mathcal{D}})-R(f^{**})] = [R(f^*_{\mathcal{H}})-R(f^{**})] + \mathbb{E}[R(f^*_{\mathcal{D}})-R(f^*_{\mathcal{H}})] $。

- 第一项近似误差(模型容量),第二项估计误差(过拟合)。

5.4.2 结构风险

- 正则化经验风险:$R_\lambda(f,\mathcal{D}) = R(f,\mathcal{D}) + \lambda C(f)$。

- 结构风险最小化:最小化正则化总体风险的估计,但实际用交叉验证或统计学习理论界限。

5.4.3 交叉验证

- 划分训练/验证集,评估不同超参数下的验证风险,选择最优 $\lambda$,再在整个数据集上重新训练。

5.4.4 统计学习理论 *

- Hoeffding不等式 + 并集界 → 有限假设空间下,泛化误差的界:$\Pr(\max_{h\in\mathcal{H}} |R(h)-R(h,\mathcal{D})| > \epsilon) \le 2|\mathcal{H}|e^{-2N\epsilon^2}$。

- VC维:度量无限假设空间的复杂度。

5.5 频率派假设检验 *

5.5.1 似然比检验

- 比较两个假设 $H_0$ 与 $H_1$,若似然比 $>1$ 则接受 $H_0$(在0-1损失下)。

- 复合假设:通过最大化似然比(如广义似然比检验)。

5.5.2 第一类与第二类错误

- 第一类错误(假阳性):$\alpha$,显著性水平。

- 第二类错误(假阴性):$\beta$,功效 $1-\beta$。

- Neyman-Pearson引理:似然比检验在固定 $\alpha$ 下功效最高。

5.5.3 零假设显著性检验(NHST)与p值

- p值:在零假设下,观察到当前统计量或更极端值的概率。若 $p < \alpha$,拒绝 $H_0$。

- 需要知道统计量的抽样分布,可用渐近正态或自助法。

5.5.4 p值有害论

- p值不是 $p(H_0|\mathcal{D})$,常被误解。贝叶斯后验可能远大于p值(示例:表5.8)。

- 许多统计学家呼吁放弃NHST。

5.5.5 为什么不是每个人都是贝叶斯主义者?

- 历史原因、计算复杂性、对先验的担忧。但现代计算使贝叶斯方法越来越可行。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 贝叶斯决策 | COVID-19治疗决策 |

| ROC曲线 | 分类器性能比较 |

| PR曲线 | 信息检索中的精确率-召回率 |

| 模型选择 | 多项式次数选择(图5.5-5.6) |

| BIC | 比较不同协方差结构的高斯模型 |

| 贝叶斯t检验 | 比较两个分类器的准确率差异 |

| 风险函数 | 高斯均值估计的不同估计量风险(图5.8) |

| 交叉验证 | 岭回归λ选择(图4.7) |

| p值 | 药物试验中p=0.05但后验概率仍可能高 |

前后章节联系

- 第4章:提供了后验分布(贝叶斯)和估计量(频率派)的基础。

- 第6章:信息论中的熵、KL散度用于决策中的损失函数。

- 第7-8章:优化方法用于最小化风险。

- 第10-11章:逻辑回归和线性回归的决策边界与损失函数。

- 第18章:集成方法(如随机森林)可视为经验风险最小化的变体。

本章核心要点

- 决策的核心:在不确定性下选择行动以最小化期望损失。

- 贝叶斯决策:利用后验分布计算期望损失,得到最优行动。

- 分类决策:0-1损失对应MAP,代价敏感需调整阈值,拒绝选项可减少错误。

- 回归决策:L2损失对应后验均值,L1损失对应后验中位数,Huber损失鲁棒。

- 概率预测:用对数损失或Brier分数评估分布预测。

- 模型选择:通过边际似然、BIC、交叉验证等比较模型,贝叶斯因子提供量化证据。

- 频率派决策:风险函数、最小最大估计、可容许性。

- 经验风险最小化:用训练集误差近似总体误差,但需正则化防过拟合。

- 假设检验:p值常被误解,贝叶斯方法提供更直接的概率解释。

常见难点

- 区分后验期望损失与频率派风险。

- 理解贝叶斯因子与p值的本质不同。

- 掌握ROC曲线与PR曲线的适用场景。

- 理解BIC、AIC、WAIC的推导与适用条件。

- 理解可容许估计量为何可能包含平凡估计(如常值估计)。

- 理解经验风险与结构风险的关系。

学习建议

- 手动计算简单例子的后验期望损失(如COVID-19例子)。

- 用Python绘制ROC和PR曲线,理解AUC。

- 模拟数据,比较不同模型选择准则(BIC vs 交叉验证)。

- 阅读关于p值争议的文章,加深对频率派与贝叶斯差异的理解。

- 将本章内容与后续模型(如逻辑回归、SVM)的损失函数联系起来。

以上是第5章“决策理论”的详细讲解。决策理论将概率模型与实际行动联系起来,是机器学习从“学习”到“应用”的关键桥梁。掌握本章内容将帮助您在实际问题中做出合理决策,并正确评估模型。如有疑问,欢迎继续探讨!

第6章“Information Theory”详细讲解

信息论是机器学习的重要理论基础,它提供了量化不确定性、信息和依赖关系的数学框架。本章从熵开始,逐步引入交叉熵、相对熵(KL散度)和互信息,并探讨它们在机器学习中的广泛应用——从损失函数(如交叉熵损失)到模型选择(如KL散度与MLE的联系),再到特征选择(互信息)。理解这些概念将帮助我们更深刻地把握概率模型、深度学习、自监督学习等领域的核心思想。

6.1 熵

6.1.1 离散随机变量的熵

- 定义:熵度量一个随机变量的不确定性,或信息内容。 $$ H(X) = -\sum_{k=1}^K p(X=k) \log_2 p(X=k) = -\mathbb{E}[\log p(X)] $$ 单位:比特(若用 $\log_2$)或纳特(若用 $\ln$)。

- 性质:

- 非负:$H(X) \ge 0$。

- 均匀分布时熵最大:$H(X) \le \log_2 K$,当且仅当所有 $p_k = 1/K$ 时取等。

- 确定性分布(某状态概率为1)熵为0。

- 二值熵函数: $$ H(\theta) = -\theta\log_2\theta - (1-\theta)\log_2(1-\theta) $$ 图6.1显示最大值在 $\theta=0.5$(1比特),最小值在 $\theta=0$ 或 $1$(0比特)。

实例:DNA序列标识(图6.2)

- 将多个对齐的DNA序列在每个位置上统计四种碱基的频率,得到位置权重矩阵。用熵 $H_t$ 度量该位置的不确定性,然后用 $R_t = 2 - H_t$(最大熵2比特)表示信息含量,以字母高度可视化(序列标识)。

熵的估计

- 当状态数很大(如词汇表)时,需估计分布 $p$,常用平滑技术。

6.1.2 交叉熵

- 定义: $$ H_{ce}(p,q) = -\sum_{k} p_k \log q_k $$ 解释:用分布 $q$ 编码来自 $p$ 的数据所需的平均比特数(若 $q$ 是真实分布,则最优编码比特数为熵 $H(p)$)。

6.1.3 联合熵

- 定义: $$ H(X,Y) = -\sum_{x,y} p(x,y) \log p(x,y) $$

- 性质:

- $H(X,Y) \le H(X) + H(Y)$,等号当且仅当 $X$ 与 $Y$ 独立。

- 下界:$H(X,Y) \ge \max\{H(X),H(Y)\}$。

示例:素数-偶数数字表(6.1.3)

- 给定数字1-8,定义 $X$ 为偶数指示,$Y$ 为质数指示。计算联合分布,得 $H(X,Y)=1.81 < H(X)+H(Y)=2$。

6.1.4 条件熵

- 定义:给定 $X$ 后 $Y$ 的剩余不确定性: $$ H(Y|X) = \sum_x p(x) H(Y|X=x) = -\sum_{x,y} p(x,y) \log p(y|x) $$

- 关系:$H(X,Y) = H(X) + H(Y|X)$(链式法则)。

- 性质:$H(Y|X) \le H(Y)$,等号当且仅当 $X$ 与 $Y$ 独立。

示例(续素数-偶数)

- 计算 $H(Y|X) = 0.81 < H(Y)=1$,表明观测 $X$ 减少了对 $Y$ 的不确定性。

6.1.5 困惑度

- 定义: $$ \text{perplexity}(p) = 2^{H(p)} $$ 对于语言模型,常用指数化交叉熵:$\text{perplexity}(p_{\mathcal{D}},p) = 2^{H_{ce}(p_{\mathcal{D}},p)}$,可解释为预测下一个词时的平均分支因子。

6.1.6 连续随机变量的微分熵 *

- 定义: $$ h(X) = -\int p(x) \log p(x) dx $$ 可正可负,因为密度可大于1。

- 高斯分布的微分熵: $$ h(\mathcal{N}(\mu,\sigma^2)) = \frac{1}{2}\log(2\pi e\sigma^2) $$

- 离散化:将连续变量离散化为直方图可近似计算熵。

6.2 相对熵(KL散度)*

6.2.1 定义

- 衡量两个分布 $p$ 和 $q$ 之间的差异: $$ D_{\mathrm{KL}}(p\|q) = \sum_x p(x) \log \frac{p(x)}{q(x)} \quad (\text{离散}) $$ $$ D_{\mathrm{KL}}(p\|q) = \int p(x) \log \frac{p(x)}{q(x)} dx \quad (\text{连续}) $$

- 不是对称度量,不满足三角不等式。

6.2.2 解释

- 可写为: $$ D_{\mathrm{KL}}(p\|q) = -H(p) + H_{ce}(p,q) $$ 即用 $q$ 编码来自 $p$ 的数据所需的额外比特数。

6.2.3 示例:两个高斯之间的KL

- 对多元高斯: $$ D_{\mathrm{KL}}(\mathcal{N}_1\|\mathcal{N}_2) = \frac{1}{2}\left[\mathrm{tr}(\boldsymbol{\Sigma}_2^{-1}\boldsymbol{\Sigma}_1) + (\boldsymbol{\mu}_2-\boldsymbol{\mu}_1)^\top\boldsymbol{\Sigma}_2^{-1}(\boldsymbol{\mu}_2-\boldsymbol{\mu}_1) - D + \log\frac{|\boldsymbol{\Sigma}_2|}{|\boldsymbol{\Sigma}_1|}\right] $$

6.2.4 KL的非负性

- 证明:利用Jensen不等式和$\log$的凹性,得 $D_{\mathrm{KL}}(p\|q) \ge 0$,等号当且仅当 $p=q$。

6.2.5 KL与MLE

- 当 $p$ 为经验分布 $p_{\mathcal{D}}$,$q$ 为模型分布,则最小化 $D_{\mathrm{KL}}(p_{\mathcal{D}}\|q)$ 等价于最大化对数似然(式4.15)。

6.2.6 前向KL vs 反向KL

- 前向KL $D_{\mathrm{KL}}(p\|q)$ 是“零避免”的,倾向于覆盖 $p$ 的所有支撑集(mode-covering)。

- 反向KL $D_{\mathrm{KL}}(q\|p)$ 是“零强制”的,倾向于锁定 $p$ 的某个模式(mode-seeking)。

- 图6.3展示了用单峰分布逼近双峰分布时两种KL的不同结果。

6.3 互信息 *

6.3.1 定义

- 度量两个随机变量 $X$ 和 $Y$ 之间的依赖程度: $$ I(X;Y) = D_{\mathrm{KL}}(p(x,y)\|p(x)p(y)) = \sum_{x,y} p(x,y)\log\frac{p(x,y)}{p(x)p(y)} $$

- 非负,为0当且仅当独立。

6.3.2 解释

- 用熵表示: $$ I(X;Y) = H(X) - H(X|Y) = H(Y) - H(Y|X) = H(X) + H(Y) - H(X,Y) $$ 即观测 $Y$ 后 $X$ 不确定性的减少量(图6.4信息图)。

6.3.3 示例(素数-偶数)

- 计算得 $I(X;Y) = 0.19$ 比特。

6.3.4 条件互信息

- 给定 $Z$ 后 $X$ 与 $Y$ 的互信息: $$ I(X;Y|Z) = H(X|Z) + H(Y|Z) - H(X,Y|Z) $$

- 链式法则:$I(Z,Y;X) = I(Z;X) + I(Y;X|Z)$。

6.3.5 MI作为“广义相关系数”

- 对联合高斯: $$ I(X,Y) = -\frac{1}{2}\log(1-\rho^2) $$ 当 $\rho=0$ 时MI=0;$\rho=\pm1$ 时MI=∞。

- 对于非高斯连续变量,可用离散化或基于K近邻的KSG估计器(如

sklearn.feature_selection.mutual_info_regression)。

6.3.6 归一化互信息

- 由于 $I(X;Y) \le \min(H(X),H(Y))$,可定义: $$ \mathrm{NMI}(X,Y) = \frac{I(X;Y)}{\min(H(X),H(Y))} \in [0,1] $$

6.3.7 最大信息系数(MIC)

- 通过搜索最优网格划分计算归一化MI,能捕捉各种非线性关系(图6.5-6.7)。

6.3.8 数据处理不等式

- 若 $X \to Y \to Z$ 构成马尔可夫链,则 $I(X;Y) \ge I(X;Z)$,即数据处理不会增加信息。

6.3.9 充分统计量

- 若 $I(\theta; s(\mathcal{D})) = I(\theta; \mathcal{D})$,则 $s(\mathcal{D})$ 是充分统计量。最小充分统计量能最紧凑地压缩数据而不丢失信息。

6.3.10 Fano不等式 *

- 对分类问题,误差概率 $P_e$ 与互信息有关: $$ H(Y|X) \le H(P_e) + P_e\log|\mathcal{Y}| $$ 因此最大化 $I(X;Y)$(等价于最小化 $H(Y|X)$)可降低 $P_e$ 的下界。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 熵 | 二值熵函数,DNA序列标识 |

| 交叉熵 | 机器学习中的分类损失 |

| 联合熵 | 素数-偶数表 |

| 条件熵 | 同上,观测X后Y不确定性减少 |

| 困惑度 | 语言模型的平均分支因子 |

| 微分熵 | 高斯分布熵 |

| KL散度 | 两个高斯之间的KL |

| 互信息 | 联合高斯中 $I = -\frac12\log(1-\rho^2)$ |

| MIC | 检测非线性关系(图6.7) |

| 数据处理不等式 | 特征工程不应增加信息 |

| Fano不等式 | 分类误差的下界 |

前后章节联系

- 第2章:概率基础,熵的定义依赖分布。

- 第4章:MLE最小化KL散度(与经验分布)。

- 第5章:对数损失即交叉熵,Brier分数是另一种评分规则。

- 第13章:神经网络中softmax交叉熵损失。

- 第16章:KDE用核密度估计,可视为对分布的平滑近似。

- 第17章:高斯过程与核方法,可用核函数隐式定义特征空间。

- 第19章:自监督学习中的对比损失(如InfoNCE)与互信息最大化有关。

本章核心要点

- 熵:度量不确定性,均匀分布最大,确定分布最小。

- 交叉熵:作为损失函数,衡量预测分布与真实分布的差异。

- KL散度:非对称的分布距离,与MLE直接相关,分前向(mode-covering)和反向(mode-seeking)。

- 互信息:度量变量间的依赖,可用于特征选择、降维、评估表示质量。

- 重要不等式:数据处理不等式说明信息不增;Fano不等式将互信息与分类错误率联系起来。

- 信息论与深度学习:对比损失(如InfoNCE)最大化互信息下界,自监督学习利用MI学习表示。

常见难点

- 区分熵、交叉熵、KL散度及其关系。

- 理解KL非对称性的实际含义(前向 vs 反向)。

- 掌握互信息的计算(尤其对连续变量)。

- 理解Fano不等式的推导及其在分类中的意义。

- 注意微分熵与离散熵的区别(可负,依赖坐标)。

学习建议

- 动手计算简单例子的熵和互信息(如抛硬币、掷骰子)。

- 用Python的

sklearn计算连续变量的互信息(mutual_info_regression)。 - 在神经网络中替换损失函数(如用KL散度做知识蒸馏),观察效果。

- 阅读自监督学习论文,理解对比损失如何近似互信息。

- 将信息论概念与决策理论(第5章)联系起来,如熵与不确定性、交叉熵与对数损失。

以上是第6章“信息论”的详细讲解。信息论为机器学习提供了量化信息和依赖关系的语言,是理解许多现代方法(如自监督学习、变分推断、互信息最大化)的基础。掌握本章内容将有助于您更深刻地理解模型设计、损失函数和表示学习。如有疑问,欢迎继续探讨!

第7章“Linear Algebra”详细讲解

本章由Zico Kolter合著,为全书提供线性代数的基础知识。线性代数是机器学习的语言,几乎所有算法都涉及向量、矩阵及其运算。本章从基本概念出发,逐步深入到矩阵分解、求解线性系统和矩阵微积分,为后续章节(如线性回归、PCA、神经网络等)奠定数学基础。

7.1 引言

7.1.1 符号

- 向量:列向量 $\mathbf{x} \in \mathbb{R}^n$,记为 $\mathbf{x} = [x_1, x_2, \ldots, x_n]^\top$。单位向量 $\mathbf{e}_i$(one-hot向量)。

- 矩阵:$\mathbf{A} \in \mathbb{R}^{m \times n}$,元素 $A_{ij}$。行向量 $\mathbf{A}_{i,:}$,列向量 $\mathbf{A}_{:,j}$。

- 张量:多维数组,如三维张量 $A_{ijk}$。可用

reshape操作转换维度。 - 转置:$(\mathbf{A}^\top)_{ij} = A_{ji}$。

- 对称矩阵:$\mathbf{A} = \mathbf{A}^\top$。

7.1.2 向量空间

- 线性组合:$\alpha_1 \mathbf{x}_1 + \cdots + \alpha_n \mathbf{x}_n$。

- 线性无关:没有向量可表示为其余向量的线性组合。

- 张成空间(span):所有线性组合的集合。

- 基(basis):一组线性无关且张成整个空间的向量。标准基为 $\mathbf{e}_1,\ldots,\mathbf{e}_n$。

- 线性映射:$\mathbf{y} = \mathbf{A}\mathbf{x}$,其中 $\mathbf{A}$ 是矩阵。

- 列空间(range):$\{\mathbf{A}\mathbf{x} : \mathbf{x} \in \mathbb{R}^n\}$,即所有列向量的张成空间。

- 零空间(nullspace):$\{\mathbf{x} : \mathbf{A}\mathbf{x} = \mathbf{0}\}$。

- 投影:将向量投影到某子空间,如 $\hat{\mathbf{y}} = \mathbf{A}(\mathbf{A}^\top\mathbf{A})^{-1}\mathbf{A}^\top \mathbf{y}$。

7.1.3 范数

- 向量范数:

- $p$-范数:$\|\mathbf{x}\|_p = (\sum_i |x_i|^p)^{1/p}$。

- 2-范数(欧几里得):$\|\mathbf{x}\|_2 = \sqrt{\sum_i x_i^2}$。

- 1-范数:$\|\mathbf{x}\|_1 = \sum_i |x_i|$。

- $\infty$-范数:$\|\mathbf{x}\|_\infty = \max_i |x_i|$。

- 0-范数:$\|\mathbf{x}\|_0 = \#\{i: x_i \neq 0\}$(非范数,不满足齐次性)。

- 矩阵范数:

- 诱导范数:$\|\mathbf{A}\|_p = \max_{\|\mathbf{x}\|_p=1} \|\mathbf{A}\mathbf{x}\|_p$,特别地 $\|\mathbf{A}\|_2 = \sigma_{\max}(\mathbf{A})$。

- 核范数:$\|\mathbf{A}\|_* = \sum_i \sigma_i$(迹范数)。

- Frobenius范数:$\|\mathbf{A}\|_F = \sqrt{\sum_{i,j} A_{ij}^2} = \sqrt{\mathrm{tr}(\mathbf{A}^\top\mathbf{A})}$。

7.1.4 矩阵的性质

- 迹:$\mathrm{tr}(\mathbf{A}) = \sum_i A_{ii}$,满足 $\mathrm{tr}(\mathbf{AB}) = \mathrm{tr}(\mathbf{BA})$。

- 行列式:$\det(\mathbf{A})$ 度量线性变换对体积的缩放。

- 秩:列空间(或行空间)的维数。$\mathrm{rank}(\mathbf{A}) \le \min(m,n)$。

- 条件数:$\kappa(\mathbf{A}) = \|\mathbf{A}\| \|\mathbf{A}^{-1}\|$,衡量矩阵的稳定性。大条件数表示矩阵病态。

7.1.5 特殊矩阵

- 对角矩阵:$\mathrm{diag}(d_1,\ldots,d_n)$。

- 三角矩阵:上三角/下三角。

- 正定矩阵:对称矩阵 $\mathbf{A}$ 满足 $\mathbf{x}^\top\mathbf{A}\mathbf{x} > 0$ 对所有非零 $\mathbf{x}$ 成立。正定矩阵的特征值全正。

- 正交矩阵:$\mathbf{U}^\top\mathbf{U} = \mathbf{I}$,即 $\mathbf{U}^{-1} = \mathbf{U}^\top$。正交变换保持长度和角度。

7.2 矩阵乘法

7.2.1 向量-向量积

- 内积(点积):$\mathbf{x}^\top\mathbf{y} = \sum_i x_i y_i$。

- 外积:$\mathbf{x}\mathbf{y}^\top \in \mathbb{R}^{m \times n}$,$(\mathbf{x}\mathbf{y}^\top)_{ij} = x_i y_j$。

7.2.2 矩阵-向量积

- 行视角:$\mathbf{y} = \mathbf{A}\mathbf{x}$,第 $i$ 个分量是 $\mathbf{A}_{i,:}^\top\mathbf{x}$。

- 列视角:$\mathbf{y} = \mathbf{A}\mathbf{x}$ 是 $\mathbf{A}$ 的列向量的线性组合,系数为 $\mathbf{x}$。

7.2.3 矩阵-矩阵积

- 内积视角:$(\mathbf{AB})_{ij} = \mathbf{A}_{i,:}^\top\mathbf{B}_{:,j}$。

- 外积视角:$\mathbf{AB} = \sum_i \mathbf{A}_{:,i} \mathbf{B}_{i,:}^\top$(列乘行)。

- 列视角:$\mathbf{AB}$ 的第 $j$ 列 = $\mathbf{A}$ 乘以 $\mathbf{B}$ 的第 $j$ 列。

- 行视角:$\mathbf{AB}$ 的第 $i$ 行 = $\mathbf{A}$ 的第 $i$ 行乘以 $\mathbf{B}$。

7.2.4 应用:操作数据矩阵

- 设 $\mathbf{X} \in \mathbb{R}^{N \times D}$ 为设计矩阵。

- 求和:$\mathbf{1}_N^\top \mathbf{X}$ 对各列求和;$\mathbf{X}\mathbf{1}_D$ 对各行的和。

- 缩放:左乘对角矩阵缩放行,右乘对角矩阵缩放列。

- 散度矩阵:$\mathbf{S} = \mathbf{X}_c^\top \mathbf{X}_c$,其中 $\mathbf{X}_c$ 为中心化数据。

- Gram矩阵:$\mathbf{K} = \mathbf{X}\mathbf{X}^\top$,内积矩阵。

- 距离矩阵:$\mathbf{D}_{ij} = \|\mathbf{x}_i - \mathbf{x}_j\|^2$,可用向量化公式快速计算。

7.2.5 Kronecker积

- $\mathbf{A} \otimes \mathbf{B}$ 是分块矩阵,性质:$(\mathbf{A} \otimes \mathbf{B})^{-1} = \mathbf{A}^{-1} \otimes \mathbf{B}^{-1}$,$(\mathbf{A} \otimes \mathbf{B})\mathrm{vec}(\mathbf{C}) = \mathrm{vec}(\mathbf{B}\mathbf{C}\mathbf{A}^\top)$。

7.2.6 Einstein求和

- 一种简洁的表示法,自动进行张量收缩。例如 $C_{ij} = A_{ik}B_{kj}$ 写作

ij = ik,kj。库如 NumPy 的einsum可优化计算顺序。

7.3 矩阵求逆

7.3.1 方阵的逆

- $\mathbf{A}^{-1}\mathbf{A} = \mathbf{A}\mathbf{A}^{-1} = \mathbf{I}$。存在性要求 $\det(\mathbf{A}) \neq 0$。

- 2×2 逆公式:$\begin{pmatrix}a & b \\ c & d\end{pmatrix}^{-1} = \frac{1}{ad-bc}\begin{pmatrix}d & -b \\ -c & a\end{pmatrix}$。

7.3.2 Schur补

- 对分块矩阵 $\mathbf{M} = \begin{pmatrix}\mathbf{E} & \mathbf{F} \\ \mathbf{G} & \mathbf{H}\end{pmatrix}$,定义 $\mathbf{M}/\mathbf{H} = \mathbf{E} - \mathbf{F}\mathbf{H}^{-1}\mathbf{G}$(相对于 $\mathbf{H}$ 的Schur补),$\mathbf{M}/\mathbf{E} = \mathbf{H} - \mathbf{G}\mathbf{E}^{-1}\mathbf{F}$。

- 逆可用Schur补表示(式7.109-7.110)。

7.3.3 矩阵求逆引理(Sherman-Morrison-Woodbury)

- $(\mathbf{E} - \mathbf{F}\mathbf{H}^{-1}\mathbf{G})^{-1} = \mathbf{E}^{-1} + \mathbf{E}^{-1}\mathbf{F}(\mathbf{H} - \mathbf{G}\mathbf{E}^{-1}\mathbf{F})^{-1}\mathbf{G}\mathbf{E}^{-1}$。

- 应用:高效计算低秩更新,如 $(\boldsymbol{\Sigma} + \mathbf{X}\mathbf{X}^\top)^{-1} = \boldsymbol{\Sigma}^{-1} - \boldsymbol{\Sigma}^{-1}\mathbf{X}(\mathbf{I} + \mathbf{X}^\top\boldsymbol{\Sigma}^{-1}\mathbf{X})^{-1}\mathbf{X}^\top\boldsymbol{\Sigma}^{-1}$。

7.3.4 矩阵行列式引理

- $|\mathbf{A} + \mathbf{u}\mathbf{v}^\top| = (1 + \mathbf{v}^\top\mathbf{A}^{-1}\mathbf{u})|\mathbf{A}|$。

7.3.5 应用:推导MVN的条件分布

- 利用Schur补推导 $p(\mathbf{x}_1|\mathbf{x}_2)$ 的均值和协方差(式7.144-7.145)。

7.4 特征值分解(EVD)

7.4.1 基础

- 对于方阵 $\mathbf{A}$,若 $\mathbf{A}\mathbf{u} = \lambda \mathbf{u}$,$\mathbf{u} \neq \mathbf{0}$,则 $\lambda$ 为特征值,$\mathbf{u}$ 为特征向量。

- 特征方程:$\det(\lambda \mathbf{I} - \mathbf{A}) = 0$。

- 性质:$\mathrm{tr}(\mathbf{A}) = \sum \lambda_i$,$\det(\mathbf{A}) = \prod \lambda_i$。

7.4.2 对角化

- 若 $\mathbf{A}$ 有 $n$ 个线性无关的特征向量,则 $\mathbf{A} = \mathbf{U}\boldsymbol{\Lambda}\mathbf{U}^{-1}$,$\boldsymbol{\Lambda}$ 为对角矩阵。

7.4.3 对称矩阵

- 实对称矩阵可正交对角化:$\mathbf{A} = \mathbf{U}\boldsymbol{\Lambda}\mathbf{U}^\top$,$\mathbf{U}$ 正交,$\lambda_i$ 为实数。

- 正定性判定:所有 $\lambda_i > 0$。

7.4.4 二次型的几何

- $\mathbf{x}^\top\mathbf{A}\mathbf{x} = \sum_i \lambda_i (\mathbf{u}_i^\top\mathbf{x})^2$,等高线为椭球,轴方向由特征向量决定,长度与 $\lambda_i^{-1/2}$ 有关。

7.4.5 标准化与白化

- PCA白化:$\mathbf{y} = \boldsymbol{\Lambda}^{-1/2}\mathbf{U}^\top \mathbf{x}$,使协方差变为单位阵。

- ZCA白化:$\mathbf{y} = \mathbf{U}\boldsymbol{\Lambda}^{-1/2}\mathbf{U}^\top \mathbf{x}$,保持与原始数据最接近(图7.7)。

7.4.6 幂法

- 迭代 $\mathbf{v}_{t+1} = \mathbf{A}\mathbf{v}_t / \|\mathbf{A}\mathbf{v}_t\|$,收敛到最大特征值对应的特征向量。

7.4.7 收缩(deflation)

- 减去已求出的主成分,继续求下一个特征向量:$\mathbf{A}^{(2)} = \mathbf{A} - \lambda_1 \mathbf{u}_1\mathbf{u}_1^\top$。

7.4.8 特征向量优化二次型

- 在约束 $\|\mathbf{x}\|_2 = 1$ 下,最大化 $\mathbf{x}^\top\mathbf{A}\mathbf{x}$ 的解是最大特征值对应的特征向量。

7.5 奇异值分解(SVD)

7.5.1 基础

- 任意矩阵 $\mathbf{A} \in \mathbb{R}^{m \times n}$ 可分解为 $\mathbf{A} = \mathbf{U}\mathbf{S}\mathbf{V}^\top$,其中 $\mathbf{U}$ 左奇异向量(正交),$\mathbf{V}$ 右奇异向量(正交),$\mathbf{S}$ 为对角矩阵,含奇异值 $\sigma_i \ge 0$。

- 经济型SVD:只保留非零奇异值对应的部分。

7.5.2 SVD与EVD的联系

- $\mathbf{A}^\top\mathbf{A} = \mathbf{V}\mathbf{S}^2\mathbf{V}^\top$,所以 $\mathbf{V}$ 是 $\mathbf{A}^\top\mathbf{A}$ 的特征向量,$\sigma_i^2$ 是特征值。

- $\mathbf{A}\mathbf{A}^\top = \mathbf{U}\mathbf{S}^2\mathbf{U}^\top$,所以 $\mathbf{U}$ 是 $\mathbf{A}\mathbf{A}^\top$ 的特征向量。

7.5.3 伪逆

- Moore-Penrose伪逆 $\mathbf{A}^\dagger = \mathbf{V}\mathbf{S}^{-1}\mathbf{U}^\top$。若 $\mathbf{A}$ 满秩,$\mathbf{A}^\dagger = (\mathbf{A}^\top\mathbf{A})^{-1}\mathbf{A}^\top$(左逆)或 $\mathbf{A}^\dagger = \mathbf{A}^\top(\mathbf{A}\mathbf{A}^\top)^{-1}$(右逆)。

7.5.4 SVD与列空间和零空间

- 列空间由对应非零奇异值的左奇异向量张成。

- 零空间由对应零奇异值的右奇异向量张成。

7.5.5 截断SVD

- 取前 $K$ 个奇异值和对应向量,得最佳秩 $K$ 近似 $\hat{\mathbf{A}}_K = \mathbf{U}_K\mathbf{S}_K\mathbf{V}_K^\top$,误差为 $\sum_{i=K+1}^r \sigma_i$(图7.9)。

7.6 其他矩阵分解 *

7.6.1 LU分解

- $\mathbf{A} = \mathbf{L}\mathbf{U}$,$\mathbf{L}$ 下三角,$\mathbf{U}$ 上三角。通常需选主元($\mathbf{P}\mathbf{A} = \mathbf{L}\mathbf{U}$)。

7.6.2 QR分解

- $\mathbf{A} = \mathbf{Q}\mathbf{R}$,$\mathbf{Q}$ 正交,$\mathbf{R}$ 上三角。用于解最小二乘($\mathbf{R}\mathbf{w} = \mathbf{Q}^\top\mathbf{y}$)。

7.6.3 Cholesky分解

- 对称正定矩阵 $\mathbf{A} = \mathbf{L}\mathbf{L}^\top$,$\mathbf{L}$ 下三角。用于高效求逆、采样(如从MVN采样)。

7.7 求解线性系统 *

7.7.1 方阵系统

- $\mathbf{A}\mathbf{x} = \mathbf{b}$,用LU分解,先解 $\mathbf{L}\mathbf{y} = \mathbf{P}\mathbf{b}$,再解 $\mathbf{U}\mathbf{x} = \mathbf{y}$(回代)。

7.7.2 欠定系统($m < n$)

- 最小范数解:$\mathbf{x} = \mathbf{A}^\dagger \mathbf{b} = \mathbf{A}^\top(\mathbf{A}\mathbf{A}^\top)^{-1}\mathbf{b}$。

7.7.3 超定系统($m > n$)

- 最小二乘解:$\mathbf{x} = (\mathbf{A}^\top\mathbf{A})^{-1}\mathbf{A}^\top\mathbf{b}$(正规方程)。也可用QR分解或SVD提高数值稳定性。

7.8 矩阵微积分

7.8.1 导数

- 标量函数 $f: \mathbb{R} \to \mathbb{R}$,$f'(x) = \lim_{h\to0} \frac{f(x+h)-f(x)}{h}$。

7.8.2 梯度

- 对 $f: \mathbb{R}^n \to \mathbb{R}$,梯度 $\nabla f(\mathbf{x}) = \left(\frac{\partial f}{\partial x_1}, \ldots, \frac{\partial f}{\partial x_n}\right)^\top$。

7.8.3 方向导数

- 沿方向 $\mathbf{v}$ 的变化率:$D_{\mathbf{v}} f(\mathbf{x}) = \nabla f(\mathbf{x})^\top \mathbf{v}$。

7.8.4 全导数

- 若 $f(t, \mathbf{x}(t), \mathbf{y}(t))$,则全导数 $\frac{df}{dt} = \frac{\partial f}{\partial t} + \frac{\partial f}{\partial \mathbf{x}}^\top \frac{d\mathbf{x}}{dt} + \frac{\partial f}{\partial \mathbf{y}}^\top \frac{d\mathbf{y}}{dt}$。

7.8.5 Jacobian

- 对 $\mathbf{f}: \mathbb{R}^n \to \mathbb{R}^m$,Jacobian $\mathbf{J}_{\mathbf{f}}(\mathbf{x}) \in \mathbb{R}^{m \times n}$,$(J)_{ij} = \frac{\partial f_i}{\partial x_j}$。

- Jacobian-向量积(JVP) 和 向量-Jacobian积(VJP) 在自动微分中常用。

7.8.6 Hessian

- 对标量函数,Hessian $\mathbf{H}_f(\mathbf{x}) \in \mathbb{R}^{n \times n}$,$H_{ij} = \frac{\partial^2 f}{\partial x_i \partial x_j}$。

7.8.7 常用函数的梯度

- $\frac{\partial}{\partial \mathbf{x}} (\mathbf{a}^\top \mathbf{x}) = \mathbf{a}$。

- $\frac{\partial}{\partial \mathbf{x}} (\mathbf{x}^\top \mathbf{A} \mathbf{x}) = (\mathbf{A} + \mathbf{A}^\top)\mathbf{x}$。

- 矩阵函数的梯度:$\frac{\partial}{\partial \mathbf{X}} \mathrm{tr}(\mathbf{A}\mathbf{X}\mathbf{B}) = \mathbf{A}^\top\mathbf{B}^\top$,$\frac{\partial}{\partial \mathbf{X}} \log \det(\mathbf{X}) = \mathbf{X}^{-\top}$。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 向量范数 | $\|\mathbf{x}\|_2$ 欧几里得距离 |

| 矩阵范数 | $\|\mathbf{A}\|_F$ 平方和开方 |

| 正定矩阵 | $\mathbf{A} = \begin{pmatrix}2 & -1 \\ -1 & 2\end{pmatrix}$ |

| 正交矩阵 | 旋转矩阵 |

| 内积 | $\mathbf{x}^\top\mathbf{y}$ |

| 外积 | $\mathbf{x}\mathbf{y}^\top$ |

| Gram矩阵 | $\mathbf{X}\mathbf{X}^\top$ |

| 距离矩阵 | 向量化计算 |

| 特征值分解 | 协方差矩阵的特征分解(PCA) |

| SVD | 图像压缩(截断SVD) |

| 伪逆 | 解最小二乘 $\hat{\mathbf{w}} = \mathbf{X}^\dagger \mathbf{y}$ |

| 梯度 | $\nabla_{\mathbf{w}} \|\mathbf{X}\mathbf{w} - \mathbf{y}\|^2 = 2\mathbf{X}^\top(\mathbf{X}\mathbf{w} - \mathbf{y})$ |

前后章节联系

- 第2-4章:概率论和统计中用到的协方差矩阵、多元高斯的条件分布(Schur补)都依赖线性代数。

- 第8章:优化中的梯度、Hessian是矩阵微积分的直接应用。

- 第11章:线性回归的正规方程 $\mathbf{X}^\top\mathbf{X}\mathbf{w} = \mathbf{X}^\top\mathbf{y}$ 涉及矩阵运算和伪逆。

- 第20章:PCA基于协方差矩阵的特征分解或SVD。

- 第13-15章:神经网络中的前向传播(矩阵乘法)、反向传播(梯度、Jacobian)都依赖本章内容。

本章核心要点

- 基本概念:向量、矩阵、张量、范数、线性空间、特殊矩阵。

- 矩阵运算:乘法、转置、迹、行列式、秩。

- 矩阵分解:EVD、SVD、LU、QR、Cholesky,各有用途(降维、求解、稳定计算)。

- 求解线性系统:方阵、欠定、超定系统的标准解法。

- 矩阵微积分:梯度、Jacobian、Hessian是机器学习优化的基石。

- 数值注意事项:避免直接求逆,利用分解提高稳定性。

常见难点

- 理解EVD与SVD的区别与联系。

- 掌握Schur补、求逆引理的推导和应用。

- 区分矩阵的不同范数及其意义。

- 理解伪逆在不同情况下的形式(左逆 vs 右逆)。

- 掌握矩阵微积分中分子布局与分母布局的差异(本书采用分子布局)。

- 理解条件数对数值稳定性的影响。

学习建议

- 用Python(NumPy)实现本章大部分概念,如矩阵乘法、EVD、SVD、伪逆。

- 对PCA和线性回归,从矩阵角度推导并实现。

- 练习矩阵微积分,如计算简单神经网络的梯度。

- 阅读与自动微分相关的资料(如JAX、PyTorch的

autograd原理)。 - 结合后续章节(如优化、线性模型)反复运用本章知识。

以上是第7章“线性代数”的详细讲解。线性代数是机器学习的通用语言,熟练掌握本章内容将为全书的学习打下坚实基础。如有疑问,欢迎继续探讨!

第8章“Optimization”详细讲解

本章由Frederik Kunstner, Si Yi Meng, Aaron Mishkin, Sharan Vaswani, Mark Schmidt共同撰写,是机器学习的核心工具章。优化是模型拟合(第4章)的具体实现,几乎所有机器学习算法最终都归结为求解某个优化问题。本章从优化问题的基础分类开始,逐步介绍一阶方法、二阶方法、随机优化、约束优化、近端梯度以及边界优化(如EM算法),为后续各章节的模型训练打下坚实的数学基础。

8.1 引言

8.1.1 优化问题定义

目标:寻找参数 $\theta \in \Theta \subseteq \mathbb{R}^D$ 最小化损失函数 $L(\theta)$:

$$ \theta^* \in \arg\min_{\theta \in \Theta} L(\theta) $$若最大化则等价于最小化 $-L(\theta)$。我们称 $L$ 为目标函数。

局部极小值:存在邻域内所有点的函数值不小于该点。一阶必要条件:梯度 $\nabla L(\theta^*) = 0$;二阶充分条件:Hessian $\nabla^2 L(\theta^*)$ 正定(图8.1a)。

全局极小值:整个可行域内的最小值点。寻找全局最优通常困难(NP难),故常满足于局部最优。

8.1.2 约束 vs 无约束

- 无约束:$\Theta = \mathbb{R}^D$。

- 约束:$\Theta = \{\theta : g_j(\theta) \le 0, h_k(\theta) = 0\}$(图8.2)。

8.1.3 凸 vs 非凸

- 凸集:集合内任意两点的连线仍属于集合。

- 凸函数:定义在凸集上,满足 $f(\lambda x + (1-\lambda)y) \le \lambda f(x) + (1-\lambda)f(y)$。

- 凸优化:目标凸函数,可行域凸集,此时任何局部极小都是全局极小。图8.5展示了凸函数与非凸函数。

- 强凸性:存在 $m>0$ 使得 $\nabla^2 f(\theta) \succeq m\mathbf{I}$,收敛速度更快。

8.1.4 光滑 vs 非光滑

- 光滑:函数连续可微,通常要求梯度Lipschitz连续,即 $\|\nabla f(x) - \nabla f(y)\| \le L\|x-y\|$。

- 非光滑:存在不可微点,如绝对值函数、hinge损失。此时可用次梯度(subgradient): $$ \partial f(x) = \{g : f(z) \ge f(x) + g^\top(z-x) \ \forall z\} $$ 图8.9-8.10展示了次梯度的概念。

8.2 一阶方法

一阶方法仅使用梯度信息,更新形式:

$$ \theta_{t+1} = \theta_t + \eta_t \mathbf{d}_t $$其中 $\mathbf{d}_t$ 为下降方向,$\eta_t$ 为步长(学习率)。

8.2.1 下降方向

- 最速下降:取负梯度方向 $\mathbf{d}_t = -\nabla L(\theta_t)$,是局部下降最快的方向。

- 任何与负梯度夹角小于90°的方向都是下降方向(式8.18)。

8.2.2 步长选择

- 常数步长:简单但需小心,过大可能不收敛(图8.11),过小收敛慢。对二次函数,收敛要求 $\eta < 2/\lambda_{\max}(\mathbf{A})$。

- 线搜索:沿当前方向找到最优步长,如精确线搜索(二次函数有闭式解)或Armijo回溯(满足充分下降条件)。

8.2.3 收敛速度

- 线性收敛:$|L(\theta_{t+1}) - L(\theta^*)| \le \mu |L(\theta_t) - L(\theta^*)|$,其中 $\mu<1$。

- 对二次函数,收敛速度与条件数 $\kappa = \lambda_{\max}/\lambda_{\min}$ 有关:$\mu = \left(\frac{\kappa-1}{\kappa+1}\right)^2$(图8.12)。

8.2.4 动量法

- 标准动量:积累历史梯度,平滑更新方向: $$ \mathbf{m}_t = \beta \mathbf{m}_{t-1} + \eta_{t-1}\nabla L(\theta_{t-1}) $$ $$ \theta_t = \theta_{t-1} - \mathbf{m}_t $$ 相当于指数加权移动平均,$\beta=0.9$ 常见。

- Nesterov动量:先按动量“预估”下一步位置,再计算梯度(图8.13),有理论加速效果。

8.3 二阶方法

二阶方法利用曲率信息(Hessian),可更快收敛,尤其对病态问题。

8.3.1 牛顿法

- 迭代更新: $$ \theta_{t+1} = \theta_t - \eta_t \mathbf{H}_t^{-1} \mathbf{g}_t $$ 其中 $\mathbf{H}_t = \nabla^2 L(\theta_t)$。当 $\eta_t=1$ 且二次近似精确时,一步可达最小值(如线性回归)。

- 缺点:Hessian可能不正定,导致上升方向;计算和存储Hessian开销大(图8.14)。

8.3.2 拟牛顿法(BFGS)

- 迭代更新近似Hessian $\mathbf{B}_t$(或其逆 $\mathbf{C}_t$)以逼近真实Hessian,只需梯度信息。

- BFGS更新公式(式8.44)保持正定性。L-BFGS 用最近几步的梯度信息近似,内存需求 $O(MD)$,适合大规模问题。

8.3.3 信赖域方法

- 在当前点周围定义一个信赖域(通常为球),在域内优化二次模型,若模型可信则扩大区域,否则缩小。等价于添加 $\lambda \|\delta\|^2$ 的阻尼(Tikhonov正则化),保证方向下降。

8.4 随机梯度下降(SGD)

适用于目标函数为期望形式 $\mathbb{E}_z[L(\theta,z)]$ 的问题,机器学习中常见有限和问题 $L(\theta) = \frac{1}{N}\sum_n L_n(\theta)$。

8.4.1 有限和问题与小批量

- 用随机选择的子集(minibatch)近似梯度: $$ \tilde{\mathbf{g}}_t = \frac{1}{|B_t|} \sum_{n\in B_t} \nabla L_n(\theta_t) $$

- SGD每步计算快,能逃离鞍点,且有隐式正则化效果。

8.4.2 示例:线性回归的SGD(LMS算法)

- 更新 $\theta_{t+1} = \theta_t - \eta_t (\theta_t^\top \mathbf{x}_n - y_n)\mathbf{x}_n$,图8.16展示收敛过程。

8.4.3 学习率调度

- 常数学习率需调参;常用调度:分段常数、指数衰减、多项式衰减(图8.18)。需满足 Robbins-Monro 条件:$\sum \eta_t = \infty$,$\sum \eta_t^2 < \infty$。

- 学习率预热(warmup)和循环学习率(图8.19)在实践中有效。

8.4.4 迭代平均

- Polyak-Ruppert平均:$\bar{\theta}_t = \frac{1}{t}\sum_{i=1}^t \theta_i$,可降低方差,达到最优收敛速率。

- 随机权重平均(SWA):后期等权平均,提升泛化。

8.4.5 方差缩减 *

- SVRG:定期计算全梯度作为基线,用随机梯度减去基线再加全梯度(式8.66),方差随迭代减小,线性收敛。

- SAGA:维护每个样本的梯度表,更新时替换旧值,无需定期全梯度,但内存需求大。

8.4.6 预条件SGD

- 用正定矩阵 $\mathbf{M}_t$ 调整更新方向:$\theta_{t+1} = \theta_t - \eta_t \mathbf{M}_t^{-1} \tilde{\mathbf{g}}_t$。

- AdaGrad:$\mathbf{M}_t = \mathrm{diag}(\sqrt{\sum_{s=1}^t \mathbf{g}_s^2})$,对稀疏特征有效。

- RMSProp:用指数加权移动平均代替累积平方和,防止学习率过早衰减。

- Adam:结合动量(一阶矩)和RMSProp(二阶矩),加偏差校正(式8.77-8.81)。注意Adam可能不收敛,改进版如 AMSGrad、Yogi、ADOPT。

- 非对角预条件:如全矩阵AdaGrad、Shampoo,利用Kronecker结构近似。

8.5 约束优化

8.5.1 拉格朗日乘子法

- 等式约束 $h(\theta)=0$ 引入拉格朗日乘子 $\lambda$,构造 $L(\theta,\lambda) = L(\theta) + \lambda h(\theta)$,求驻点。

- 例:$\min \theta_1^2+\theta_2^2$ 满足 $\theta_1+\theta_2=1$,得解 $(\frac12,\frac12)$。

8.5.2 KKT条件

- 对不等式约束 $g(\theta) \le 0$ 和等式约束,最优解满足:可行性、梯度为零、互补松弛($\mu_i g_i(\theta)=0$)、对偶可行性 $\mu_i \ge 0$。

8.5.3 线性规划

- 目标与约束均为线性:$\min \mathbf{c}^\top \theta$ s.t. $\mathbf{A}\theta \le \mathbf{b},\ \theta \ge 0$。可行域为多面体,最优解在顶点(图8.21)。

- 单纯形法:沿边移动;内点法:多项式时间。

8.5.4 二次规划

- 目标为二次,约束线性:$\min \frac12 \theta^\top \mathbf{H}\theta + \mathbf{c}^\top \theta$ s.t. $\mathbf{A}\theta \le \mathbf{b}$。

- 例:带 $\ell_1$ 约束的最小二乘,等价于二次规划。

8.5.5 混合整数线性规划

- 变量部分为整数,用于组合优化,如神经网络验证。

8.6 近端梯度法 *

处理可分解目标 $L(\theta) = L_s(\theta) + L_r(\theta)$,其中 $L_s$ 光滑,$L_r$ 非光滑凸。

8.6.1 投影梯度下降

- 若 $L_r$ 为指示函数(如约束集),近端算子即为投影: $$ \mathrm{prox}_{\eta L_r}(\theta) = \arg\min_{z} \left( L_r(z) + \frac{1}{2\eta}\|z-\theta\|^2 \right) $$ 更新:$\theta_{t+1} = \mathrm{proj}_{\mathcal{C}}(\theta_t - \eta_t \nabla L_s(\theta_t))$(图8.22)。

8.6.2 ℓ₁正则化的近端算子

- 对 $L_r(\theta) = \lambda\|\theta\|_1$,近端算子为软阈值: $$ \mathrm{SoftThreshold}(\theta, \lambda) = \mathrm{sign}(\theta) (|\theta| - \lambda)_+ $$ 即对每个分量独立操作(图8.9)。

8.6.3 量化的近端算子

- 用于训练量化神经网络,如二值化,近端算子为到离散集的投影,可用直通估计器近似。

8.6.4 在线近端方法

- 扩展到随机/在线设置。

8.7 边界优化 *

8.7.1 MM算法

- 最大化(或最小化)时,构造一个容易优化的代理函数 $Q(\theta,\theta_t)$,满足 $Q(\theta,\theta_t) \le L(\theta)$(下界)且 $Q(\theta_t,\theta_t) = L(\theta_t)$,然后更新 $\theta_{t+1} = \arg\max Q(\theta,\theta_t)$,保证目标单调递增(图8.23)。

8.7.2 EM算法

- 处理含隐变量模型的最大似然估计。通过Jensen不等式得到ELBO(证据下界): $$ \log p(\mathcal{D}|\theta) \ge \sum_n \mathbb{E}_{q_n(z_n)}[\log p(\mathbf{y}_n,z_n|\theta)] + H(q_n) \triangleq \mathcal{L}(\theta,\{q_n\}) $$

- E步:固定 $\theta$,令 $q_n(z_n) = p(z_n|\mathbf{y}_n,\theta)$ 使下界紧。

- M步:固定 $q_n$,最大化期望完全数据对数似然,更新 $\theta$。

8.7.3 示例:GMM的EM

- E步:计算责任度 $r_{nk} = p(z_n=k|\mathbf{y}_n,\theta)$。

- M步:更新 $\pi_k$、$\mu_k$、$\Sigma_k$ 为加权平均(式8.165-8.167)。图8.25展示EM在Old Faithful数据上的收敛过程。

- MAP估计:加入先验可避免协方差奇异(图8.26)。

- 非凸性:GMM似然有多个局部最优(图8.27),初始化重要(可用K-means++)。

8.8 黑盒优化与无导数优化

- 目标函数为黑盒(如验证误差),无法求梯度。常用网格搜索、随机搜索、贝叶斯优化等(详见 [Mur23])。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| 梯度下降 | 凸二次函数(图8.11) |

| 线搜索 | 沿直线最小化(二次函数有解析解) |

| 动量 | 加速沿平坦区域(图8.13) |

| 牛顿法 | 线性回归一步到位 |

| L-BFGS | 逻辑回归默认求解器(scikit-learn) |

| SGD | 线性回归的LMS算法(图8.16) |

| 学习率调度 | 分段常数、指数衰减、预热(图8.18-8.19) |

| Adam | 深度学习默认优化器 |

| 投影梯度 | 非负约束的最小二乘 |

| 软阈值 | Lasso回归(图11.9) |

| EM | 高斯混合模型(图8.25) |

前后章节联系

- 第4章:MLE、MAP、正则化都是优化问题,本章提供求解方法。

- 第7章:梯度、Hessian、矩阵分解是本章工具。

- 第10章:逻辑回归用IRLS(牛顿法)或SGD求解。

- 第11章:线性回归的闭式解(最小二乘)、Lasso用近端梯度。

- 第13-15章:神经网络训练依赖SGD及其变种(Adam等)。

- 第20章:PCA可用幂法或EM;因子分析用EM。

- 第21章:K-means是EM的特例(硬EM)。

本章核心要点

- 优化问题分类:理解局部/全局、约束/无约束、凸/非凸、光滑/非光滑的区别,对选择算法至关重要。

- 一阶方法:梯度下降是基础,动量可加速,线搜索自适应步长。

- 二阶方法:牛顿法利用曲率,收敛快但成本高;拟牛顿(L-BFGS)是实用折中。

- 随机优化:SGD是深度学习主力,学习率调度和动量是关键;方差缩减可加速凸问题。

- 预条件:自适应方法(Adam等)自动调整各参数学习率,但需注意收敛性。

- 约束优化:拉格朗日乘子、KKT条件是理论基础;线性/二次规划有成熟解法。

- 近端梯度:处理非光滑正则项(如L1)的标准工具。

- 边界优化:MM算法(含EM)通过构造下界单调提升目标,常用于概率模型。

常见难点

- 理解动量与Nesterov动量的区别。

- 掌握方差缩减方法的原理(SVRG的控制变量思想)。

- 理解Adam中偏差校正的作用(图4.3)。

- 区分对偶问题与原始问题的关系(KKT)。

- 掌握软阈值算子的推导(从次梯度出发)。

- 理解EM为何保证单调提升(ELBO下界)。

学习建议

- 用Python实现简单的梯度下降、动量、牛顿法(对二次函数)并观察收敛。

- 在简单数据集上尝试SGD与Adam,观察学习率影响。

- 实现Lasso的软阈值迭代(ISTA)并与坐标下降对比。

- 用EM实现GMM,并与K-means比较。

- 阅读优化库(如scipy.optimize、PyTorch optim)的文档,了解实际使用。

以上是第8章“优化”的详细讲解。优化是机器学习的发动机,理解各类算法的适用场景和原理,将帮助您在模型训练中做出明智选择。如有疑问,欢迎继续探讨!

第9章“Linear Discriminant Analysis”详细讲解

本章介绍生成式分类器,其核心思想是通过对每个类别的类条件密度 $p(\mathbf{x}|y=c)$ 和类先验 $p(y=c)$ 建模,然后利用贝叶斯定理得到后验概率 $p(y=c|\mathbf{x})$。本章主要关注高斯类条件密度,由此引出线性判别分析(LDA)和二次判别分析(QDA),并介绍朴素贝叶斯分类器。最后,对比生成式与判别式分类器的优缺点。

9.1 引言

- 生成式分类器:建模联合分布 $p(\mathbf{x}, y) = p(y)p(\mathbf{x}|y)$,再通过贝叶斯公式得到后验: $$ p(y=c|\mathbf{x}) = \frac{p(y=c) p(\mathbf{x}|y=c)}{\sum_{c'} p(y=c') p(\mathbf{x}|y=c')} $$

- 判别式分类器:直接建模后验 $p(y=c|\mathbf{x})$,如逻辑回归(第10章)。

- 本章重点:当类条件密度取为高斯分布时,后验形式简化,产生线性或二次决策边界。

9.2 高斯判别分析(Gaussian Discriminant Analysis, GDA)

9.2.1 模型定义

假设每个类 $c$ 的类条件密度为多元高斯:

$$ p(\mathbf{x}|y=c) = \mathcal{N}(\mathbf{x}|\boldsymbol{\mu}_c, \boldsymbol{\Sigma}_c) $$类先验为 $p(y=c) = \pi_c$(通常用MLE估计)。则后验为:

$$ p(y=c|\mathbf{x}) \propto \pi_c \mathcal{N}(\mathbf{x}|\boldsymbol{\mu}_c, \boldsymbol{\Sigma}_c) $$9.2.2 二次判别分析(QDA)

当每个类有自己的协方差矩阵 $\boldsymbol{\Sigma}_c$ 时,后验对数形式:

$$ \log p(y=c|\mathbf{x}) = \log\pi_c - \frac{1}{2}\log|\boldsymbol{\Sigma}_c| - \frac{1}{2}(\mathbf{x}-\boldsymbol{\mu}_c)^\top\boldsymbol{\Sigma}_c^{-1}(\mathbf{x}-\boldsymbol{\mu}_c) + \text{const} $$比较类 $c$ 与 $c'$ 的判别函数,得到 $\mathbf{x}$ 的二次函数 → 二次决策边界。

示例:图9.1-9.2a展示了3类2d数据,每类协方差不同,决策边界为曲线。

9.2.3 线性判别分析(LDA)

当假设所有类共享协方差矩阵 $\boldsymbol{\Sigma}_c = \boldsymbol{\Sigma}$ 时,后验对数中的二次项 $\mathbf{x}^\top\boldsymbol{\Sigma}^{-1}\mathbf{x}$ 与类无关,可消去,剩下线性项:

$$ \log p(y=c|\mathbf{x}) = \log\pi_c - \frac{1}{2}\boldsymbol{\mu}_c^\top\boldsymbol{\Sigma}^{-1}\boldsymbol{\mu}_c + \mathbf{x}^\top\boldsymbol{\Sigma}^{-1}\boldsymbol{\mu}_c + \text{const} $$记 $\gamma_c = \log\pi_c - \frac{1}{2}\boldsymbol{\mu}_c^\top\boldsymbol{\Sigma}^{-1}\boldsymbol{\mu}_c$,$\boldsymbol{\beta}_c = \boldsymbol{\Sigma}^{-1}\boldsymbol{\mu}_c$,则

$$ \log p(y=c|\mathbf{x}) = \gamma_c + \mathbf{x}^\top\boldsymbol{\beta}_c $$决策边界为线性超平面(图9.2b)。

9.2.4 LDA与逻辑回归的联系

- LDA的类后验可写为 softmax 形式 $p(y=c|\mathbf{x}) = \frac{e^{\gamma_c + \mathbf{x}^\top\boldsymbol{\beta}_c}}{\sum_{c'}e^{\gamma_{c'} + \mathbf{x}^\top\boldsymbol{\beta}_{c'}}}$,与多类逻辑回归形式相同。

- 区别:LDA通过拟合高斯类条件密度(MLE)得到 $\boldsymbol{\mu}_c,\boldsymbol{\Sigma},\pi_c$,再导出 $\boldsymbol{\beta}_c,\gamma_c$;而逻辑回归直接最大化条件似然 $p(y|\mathbf{x})$ 估计 $\boldsymbol{\beta}_c,\gamma_c$。两者一般给出不同参数值。

对于二分类,可进一步简化:

$$ p(y=1|\mathbf{x}) = \sigma\big((\boldsymbol{\mu}_1-\boldsymbol{\mu}_0)^\top\boldsymbol{\Sigma}^{-1}\mathbf{x} + (\gamma_1-\gamma_0)\big) $$其中 $\sigma$ 为sigmoid。若先验相等 $\pi_1=\pi_0$,决策边界为 $\mathbf{x}^\top\boldsymbol{\Sigma}^{-1}(\boldsymbol{\mu}_1-\boldsymbol{\mu}_0) = \frac{1}{2}(\boldsymbol{\mu}_1-\boldsymbol{\mu}_0)^\top\boldsymbol{\Sigma}^{-1}(\boldsymbol{\mu}_1+\boldsymbol{\mu}_0)$,即点 $\mathbf{x}$ 投影到方向 $\boldsymbol{\Sigma}^{-1}(\boldsymbol{\mu}_1-\boldsymbol{\mu}_0)$ 后与阈值比较(图9.3)。

9.2.5 模型拟合(MLE)

似然函数:

$$ p(\mathcal{D}|\theta) = \prod_{n=1}^N \prod_{c=1}^C \left[\pi_c \mathcal{N}(\mathbf{x}_n|\boldsymbol{\mu}_c,\boldsymbol{\Sigma}_c)\right]^{\mathbb{I}(y_n=c)} $$对数似然分解为:

$$ \log p(\mathcal{D}|\theta) = \sum_{n,c} \mathbb{I}(y_n=c)\log\pi_c + \sum_c \sum_{n:y_n=c} \log\mathcal{N}(\mathbf{x}_n|\boldsymbol{\mu}_c,\boldsymbol{\Sigma}_c) $$MLE估计:

- 先验:$\hat{\pi}_c = N_c/N$。

- 类均值:$\hat{\boldsymbol{\mu}}_c = \frac{1}{N_c}\sum_{n:y_n=c} \mathbf{x}_n$。

- 类协方差:$\hat{\boldsymbol{\Sigma}}_c = \frac{1}{N_c}\sum_{n:y_n=c} (\mathbf{x}_n-\hat{\boldsymbol{\mu}}_c)(\mathbf{x}_n-\hat{\boldsymbol{\mu}}_c)^\top$。

共享协方差(LDA):$\hat{\boldsymbol{\Sigma}} = \frac{1}{N}\sum_c \sum_{n:y_n=c} (\mathbf{x}_n-\hat{\boldsymbol{\mu}}_c)(\mathbf{x}_n-\hat{\boldsymbol{\mu}}_c)^\top$。

对角协方差:假设 $\boldsymbol{\Sigma}_c$ 为对角,减少参数,但忽略特征间相关性(相当于朴素贝叶斯假设)。

正则化:用MAP估计(如收缩估计)防止小样本下协方差奇异(RDA,正则化判别分析)。

9.2.6 最近质心分类器

- 若先验均匀且协方差为单位矩阵(或假设为球形),则决策规则简化为: $$ \hat{y}(\mathbf{x}) = \arg\min_c \|\mathbf{x} - \boldsymbol{\mu}_c\|_2^2 $$ 即分配 $\mathbf{x}$ 到最近的类均值(欧氏距离)。可推广到马氏距离或学习到的距离度量(如通过线性变换 $\mathbf{W}$ 后的欧氏距离,称为最近类均值度量学习)。

9.2.7 Fisher线性判别分析(FLDA)*

- 目标:寻找投影方向 $\mathbf{w}$ 使得投影后类间离散度大、类内离散度小。

- 定义:

- 类间散度矩阵 $\mathbf{S}_B = (\boldsymbol{\mu}_2 - \boldsymbol{\mu}_1)(\boldsymbol{\mu}_2 - \boldsymbol{\mu}_1)^\top$。

- 类内散度矩阵 $\mathbf{S}_W = \sum_{n:y_n=1}(\mathbf{x}_n-\boldsymbol{\mu}_1)(\mathbf{x}_n-\boldsymbol{\mu}_1)^\top + \sum_{n:y_n=2}(\mathbf{x}_n-\boldsymbol{\mu}_2)(\mathbf{x}_n-\boldsymbol{\mu}_2)^\top$。

- 优化准则: $$ J(\mathbf{w}) = \frac{\mathbf{w}^\top \mathbf{S}_B \mathbf{w}}{\mathbf{w}^\top \mathbf{S}_W \mathbf{w}} $$ 最大化 $J$ 的解为 $\mathbf{w} \propto \mathbf{S}_W^{-1}(\boldsymbol{\mu}_2 - \boldsymbol{\mu}_1)$(二分类)。对于多类,可求投影矩阵 $\mathbf{W}$,使 $\frac{|\mathbf{W}^\top\mathbf{S}_B\mathbf{W}|}{|\mathbf{W}^\top\mathbf{S}_W\mathbf{W}|}$ 最大,解为 $\mathbf{S}_W^{-1}\mathbf{S}_B$ 的最大特征值对应的特征向量(图9.4-9.5)。

- 限制:最多可找到 $C-1$ 个投影方向,因为 $\mathbf{S}_B$ 秩为 $C-1$。

9.3 朴素贝叶斯分类器(Naive Bayes Classifier, NBC)

9.3.1 朴素贝叶斯假设

- 在给定类标签下,特征之间条件独立: $$ p(\mathbf{x}|y=c) = \prod_{d=1}^D p(x_d|y=c) $$ 因此后验为: $$ p(y=c|\mathbf{x}) \propto \pi_c \prod_{d=1}^D p(x_d|y=c) $$

9.3.2 示例模型

- 二值特征:$p(x_d|y=c) = \mathrm{Ber}(x_d|\theta_{dc})$。图9.6展示了MNIST二值化数据上学习的 $\theta_{dc}$(每个类每个像素的“开启”概率)。

- 类别特征:$p(x_d|y=c) = \mathrm{Cat}(x_d|\theta_{dc})$。

- 实值特征:$p(x_d|y=c) = \mathcal{N}(x_d|\mu_{dc},\sigma_{dc}^2)$(即对角协方差高斯,等价于QDA对角版本)。

9.3.3 模型拟合

- 对数似然分解为独立项: $$ \log p(\mathcal{D}|\theta) = \sum_c \sum_{n:y_n=c} \log\pi_c + \sum_c \sum_d \sum_{n:y_n=c} \log p(x_{nd}|\theta_{dc}) $$

- MLE:

- $\hat{\pi}_c = N_c/N$。

- 对伯努利:$\hat{\theta}_{dc} = \frac{N_{dc}}{N_c}$,其中 $N_{dc}$ 是类 $c$ 中特征 $d$ 为1的次数。

- 对高斯:$\hat{\mu}_{dc} = \frac{1}{N_c}\sum_{n:y_n=c} x_{nd}$,$\hat{\sigma}_{dc}^2 = \frac{1}{N_c}\sum_{n:y_n=c} (x_{nd}-\hat{\mu}_{dc})^2$。

9.3.4 贝叶斯朴素贝叶斯

- 引入共轭先验(如Dirichlet用于类别特征,Beta用于伯努利,高斯-逆Gamma用于高斯),得到后验。预测时用后验均值参数,实现平滑(如拉普拉斯平滑 $\hat{\theta}_{dc} = \frac{1 + N_{dc}}{2 + N_c}$)。

9.3.5 与逻辑回归的联系

- 将朴素贝叶斯的后验写成 softmax 形式: $$ p(y=c|\mathbf{x}) = \frac{\exp\left(\log\pi_c + \sum_d \log p(x_d|y=c)\right)}{\sum_{c'}\exp\left(\log\pi_{c'} + \sum_d \log p(x_d|y=c')\right)} $$ 若每个 $\log p(x_d|y=c)$ 是 $x_d$ 的线性函数(如伯努利时 $\log p = x_d\log\frac{\theta_{dc}}{1-\theta_{dc}} + \log(1-\theta_{dc})$),则整体是指数族形式,与多类逻辑回归形式相同。但估计方法不同(生成式 vs 判别式)。

9.4 生成式 vs 判别式分类器

9.4.1 判别式分类器的优点

- 预测准确率更高:判别式模型直接针对分类任务,无需建模输入分布,往往在有限数据下表现更好(图9.8)。

- 灵活处理特征工程:可对输入进行任意非线性变换,不必担心特征间的复杂依赖。

- 概率校准好:逻辑回归通常给出较可靠的概率估计,而朴素贝叶斯可能因独立性假设产生极端概率。

9.4.2 生成式分类器的优点

- 拟合简单:通常只需计数和平均,无需迭代优化(如朴素贝叶斯)。

- 自然处理缺失特征:在测试时,若部分特征缺失,可在类条件密度中边缘化缺失变量(式9.63-9.65)。

- 可分开训练各类:每类的参数独立估计,添加新类无需重新训练整个模型。

- 可利用无标签数据(半监督学习):通过生成模型,未标记数据可帮助估计类条件密度。

- 对虚假特征更鲁棒:生成式模型学习数据产生机制,可能更稳健应对分布偏移。

9.4.3 处理缺失特征

- 在生成式模型中,若测试时某些特征缺失,只需对缺失特征积分: $$ p(y=c|\mathbf{x}_{\text{obs}}) \propto \pi_c \int p(\mathbf{x}_{\text{obs}},\mathbf{x}_{\text{mis}}|y=c) d\mathbf{x}_{\text{mis}} = \pi_c p(\mathbf{x}_{\text{obs}}|y=c) $$ 在朴素贝叶斯下,积分简化为只使用观测特征(因为条件独立,缺失特征可忽略)。在GDA中,可利用高斯条件分布公式计算。

概念关系图

实例汇总

| 概念 | 实例 |

|---|---|

| QDA | 图9.2a,不同类协方差不同,边界曲线 |

| LDA | 图9.2b,共享协方差,边界直线 |

| 最近质心 | 图9.3,投影到均值连线,用阈值分类 |

| FLDA | 图9.4-9.5,投影后类分离更好 |

| 朴素贝叶斯(伯努利) | 图9.6,MNIST二值化学习到的每个像素激活概率 |

| 朴素贝叶斯预测 | 图9.7,测试图像分类 |

| 缺失特征处理 | 测试时仅用观测特征,生成式可边缘化 |

前后章节联系

- 第2-3章:多元高斯分布、条件高斯公式用于GDA;概率图模型视角下,朴素贝叶斯可视为简单图模型。

- 第4章:MLE、MAP估计用于拟合GDA和朴素贝叶斯。

- 第10章:逻辑回归(判别式)与LDA/朴素贝叶斯对比。

- 第11章:线性回归与高斯判别分析的联系(当输出为连续时)。

- 第20章:PCA(无监督降维)与FLDA(有监督降维)对比。

本章核心要点

- 生成式分类器:通过建模 $p(\mathbf{x}|y)$ 和 $p(y)$ 得到后验。

- 高斯判别分析:

- QDA:每类不同协方差 → 二次边界。

- LDA:共享协方差 → 线性边界。

- 参数可由MLE解析估计。

- LDA与逻辑回归:形式相同但估计准则不同(联合似然 vs 条件似然)。

- 朴素贝叶斯:特征条件独立假设,极大简化模型,易于拟合,对缺失数据友好。

- Fisher LDA:寻找最佳投影方向最大化类间/类内散度比,用于降维。

- 生成式 vs 判别式:各有优缺点,选择取决于应用场景和数据特点。

常见难点

- 理解LDA与逻辑回归在形式上的相同与实质上的不同(参数估计方法)。

- 掌握共享协方差如何导致线性边界的推导(消去二次项)。

- 理解朴素贝叶斯的条件独立假设为何在特征相关时仍可能有效(概率校准可能差,但分类边界可能仍合理)。

- 理解FLDA中为什么最多只能得到 $C-1$ 个投影方向。

- 区分生成式分类器处理缺失特征与判别式分类器(判别式通常需填充或忽略)。

学习建议

- 用Python实现LDA和QDA(可用

sklearn.discriminant_analysis),观察决策边界。 - 对比LDA与逻辑回归在同一数据集上的参数差异。

- 实现朴素贝叶斯分类器(对连续特征用高斯朴素贝叶斯),观察预测效果。

- 尝试用FLDA对高维数据降维后再分类,比较与PCA的区别。

- 阅读生成式与判别式对比的经典论文(如Ng & Jordan, 2002),加深理解。

以上是第9章“线性判别分析”的详细讲解。掌握本章内容将帮助您理解生成式模型的构建及其与判别式模型的本质区别。如有疑问,欢迎继续探讨!

第10章“Logistic Regression”详细讲解

逻辑回归是机器学习中最基础、应用最广泛的分类模型。尽管名字中有“回归”,但它实际上是用于分类的判别式模型。本章从二分类开始,逐步扩展到多分类,介绍模型形式、参数估计方法(MLE、MAP)、优化算法(梯度下降、IRLS、SGD)、正则化、鲁棒扩展以及贝叶斯视角。掌握逻辑回归对理解后续神经网络(作为softmax分类器的基础)和其他广义线性模型至关重要。

10.1 引言

逻辑回归是一种判别式分类模型,直接建模后验概率 $p(y|\mathbf{x};\theta)$。输入 $\mathbf{x} \in \mathbb{R}^D$,输出 $y \in \{1,\ldots,C\}$。对于二分类($C=2$),称为二元逻辑回归;对于多分类($C>2$),称为多项逻辑回归(或softmax回归)。

10.2 二元逻辑回归

10.2.1 模型定义

二元逻辑回归假设:

$$ p(y=1|\mathbf{x};\theta) = \sigma(\mathbf{w}^\top\mathbf{x} + b) $$其中 $\sigma(a) = \frac{1}{1+e^{-a}}$ 是 sigmoid 函数(第2.4.2节),$\mathbf{w}$ 为权重向量,$b$ 为偏置(截距),$\theta = (\mathbf{w}, b)$。于是 $p(y=0|\mathbf{x}) = 1 - p(y=1|\mathbf{x})$。

若用标签 $\tilde{y} \in \{-1, +1\}$,可写为 $p(\tilde{y}|\mathbf{x}) = \sigma(\tilde{y} a)$,其中 $a = \mathbf{w}^\top\mathbf{x} + b$。

10.2.2 线性分类器

- 决策边界:当 $p(y=1|\mathbf{x}) > 0.5$ 时预测为1,等价于 $a > 0$。因此决策边界为超平面 $\mathbf{w}^\top\mathbf{x} + b = 0$(图10.1)。

- 几何意义:$\mathbf{w}$ 是法向量,$b$ 控制偏移。$\|\mathbf{w}\|$ 越大,sigmoid越陡峭,分类置信度越高(图10.2)。

10.2.3 非线性分类器

通过对输入做特征变换 $\phi(\mathbf{x})$,模型变为 $p(y=1|\mathbf{x}) = \sigma(\mathbf{w}^\top\phi(\mathbf{x}) + b)$。例如多项式特征(图10.3)可将线性不可分问题转化为线性可分。但需注意,特征过多可能导致过拟合(图10.4)。

10.2.4 最大似然估计(MLE)

- 负对数似然(NLL):假设数据集 $\mathcal{D} = \{(\mathbf{x}_n, y_n)\}_{n=1}^N$,$y_n \in \{0,1\}$,则 $$ \mathrm{NLL}(\mathbf{w}) = -\frac{1}{N}\sum_{n=1}^N \left[y_n\log\mu_n + (1-y_n)\log(1-\mu_n)\right] $$ 其中 $\mu_n = \sigma(\mathbf{w}^\top\mathbf{x}_n)$。这等价于交叉熵损失。

- 梯度: $$ \nabla_{\mathbf{w}} \mathrm{NLL} = \frac{1}{N}\sum_{n=1}^N (\mu_n - y_n) \mathbf{x}_n $$ 直观解释:误差 $(\mu_n - y_n)$ 乘以输入,再平均。

- Hessian: $$ \mathbf{H} = \frac{1}{N}\sum_{n=1}^N \mu_n(1-\mu_n) \mathbf{x}_n\mathbf{x}_n^\top = \frac{1}{N}\mathbf{X}^\top \mathbf{S} \mathbf{X} $$ 其中 $\mathbf{S} = \mathrm{diag}(\mu_n(1-\mu_n))$。Hessian正定(当 $\mu_n \in (0,1)$),因此NLL是凸函数,有唯一全局最优(图10.5)。

10.2.5 随机梯度下降(SGD)

对每个样本(或小批量)更新:

$$ \mathbf{w}_{t+1} = \mathbf{w}_t - \eta_t (\mu_n - y_n) \mathbf{x}_n $$简单且可扩展,适用于大规模数据。

10.2.6 感知机算法

感知机是逻辑回归的“硬”版本:预测 $\hat{y}_n = \mathrm{sign}(\mathbf{w}^\top\mathbf{x}_n + b)$。更新规则:

$$ \mathbf{w}_{t+1} = \mathbf{w}_t - \eta_t (\hat{y}_n - y_n) \mathbf{x}_n $$与SGD类似,但用硬标签代替概率。感知机仅在线性可分数据上收敛,而逻辑回归总能找到最优解。

10.2.7 迭代重加权最小二乘(IRLS)

牛顿法应用于逻辑回归得到IRLS。更新公式:

$$ \mathbf{w}_{t+1} = (\mathbf{X}^\top \mathbf{S}_t \mathbf{X})^{-1} \mathbf{X}^\top \mathbf{S}_t \mathbf{z}_t $$其中 $\mathbf{z}_t = \mathbf{X}\mathbf{w}_t + \mathbf{S}_t^{-1}(\mathbf{y} - \boldsymbol{\mu}_t)$ 是“工作响应”。每次迭代解一个加权最小二乘问题,故得名。

10.2.8 MAP估计(正则化)

为避免过拟合,引入高斯先验 $p(\mathbf{w}) = \mathcal{N}(\mathbf{w}|\mathbf{0}, \lambda^{-1}\mathbf{I})$,得目标:

$$ L(\mathbf{w}) = \mathrm{NLL}(\mathbf{w}) + \lambda \|\mathbf{w}\|_2^2 $$称为 $\ell_2$ 正则化或权重衰减。梯度与Hessian只需加上 $2\lambda\mathbf{w}$ 和 $2\lambda\mathbf{I}$。图10.6展示正则化效果。

10.2.9 标准化

由于正则化对所有权重尺度一视同仁,输入特征应标准化(零均值、单位方差),否则正则化效果受特征尺度影响。

10.3 多项逻辑回归(Multinomial Logistic Regression)

10.3.1 模型定义

对于 $C$ 类分类,模型为:

$$ p(y=c|\mathbf{x}) = \frac{\exp(\mathbf{w}_c^\top\mathbf{x} + b_c)}{\sum_{j=1}^C \exp(\mathbf{w}_j^\top\mathbf{x} + b_j)} = \mathrm{softmax}_c(\mathbf{W}\mathbf{x} + \mathbf{b}) $$其中 $\mathbf{W}$ 为 $C\times D$ 权重矩阵,$\mathbf{b}$ 为 $C$ 维偏置。由于 $\sum_c p(y=c|\mathbf{x})=1$,可令最后一类参数为0(或使用对称约束),实际上有 $(C-1)D$ 个自由参数。

10.3.2 线性与非线性分类器

- 原始特征下,决策边界为线性超平面(图10.7a)。

- 通过特征变换 $\phi(\mathbf{x})$ 可得非线性边界(图10.7b),例如二次特征。

10.3.3 最大似然估计

- 负对数似然(交叉熵): $$ \mathrm{NLL}(\theta) = -\frac{1}{N}\sum_{n=1}^N \sum_{c=1}^C y_{nc} \log \mu_{nc} $$ 其中 $\mu_{nc} = p(y=c|\mathbf{x}_n)$,$y_{nc}$ 是 one-hot 标签。

- 梯度: $$ \nabla_{\mathbf{w}_c} \mathrm{NLL} = \frac{1}{N}\sum_{n=1}^N (\mu_{nc} - y_{nc}) \mathbf{x}_n $$ 与二元情况形式一致,每个类有一个梯度。

- Hessian:块结构,第 $c,c'$ 块为 $\frac{1}{N}\sum_n \mu_{nc}(\delta_{c,c'} - \mu_{nc'}) \mathbf{x}_n\mathbf{x}_n^\top$。Hessian正定,NLL凸。

10.3.4 梯度优化

- SGD:每个样本更新对应类的权重。

- 拟牛顿法(如L-BFGS)常用于中小规模数据。

10.3.5 边界优化(MM算法)